英伟达推开源模型:算力下沉,App如何跨越底层唤醒?

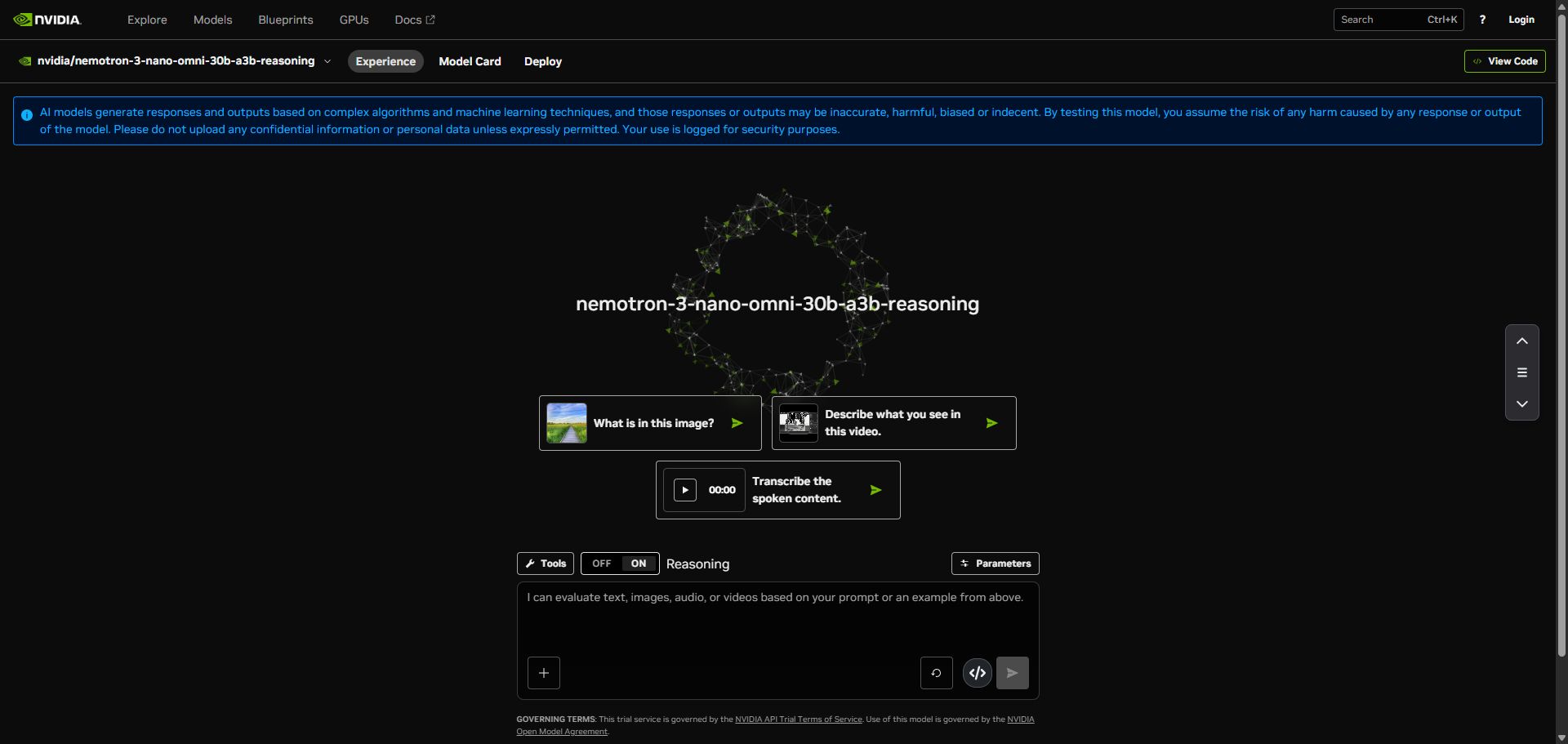

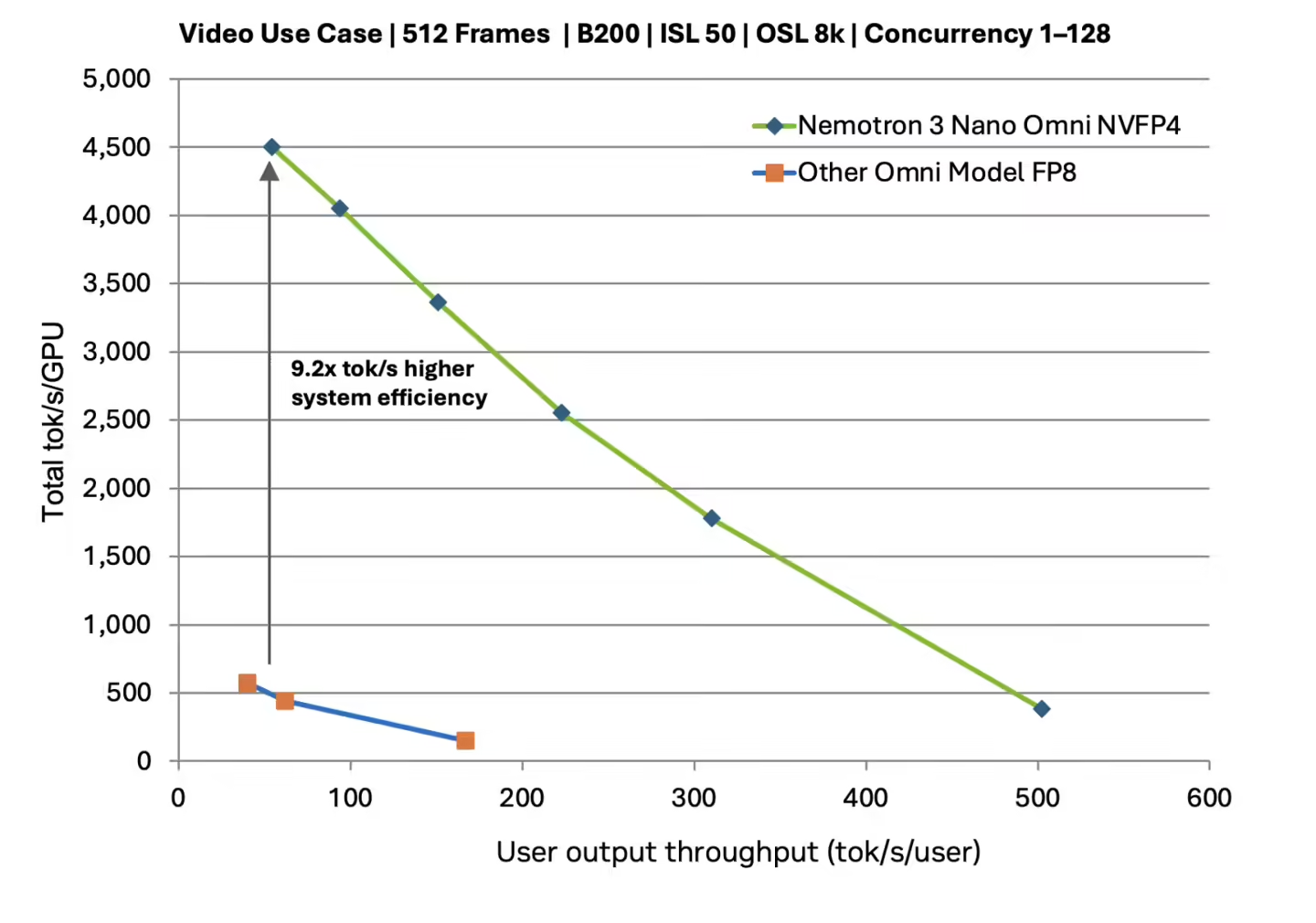

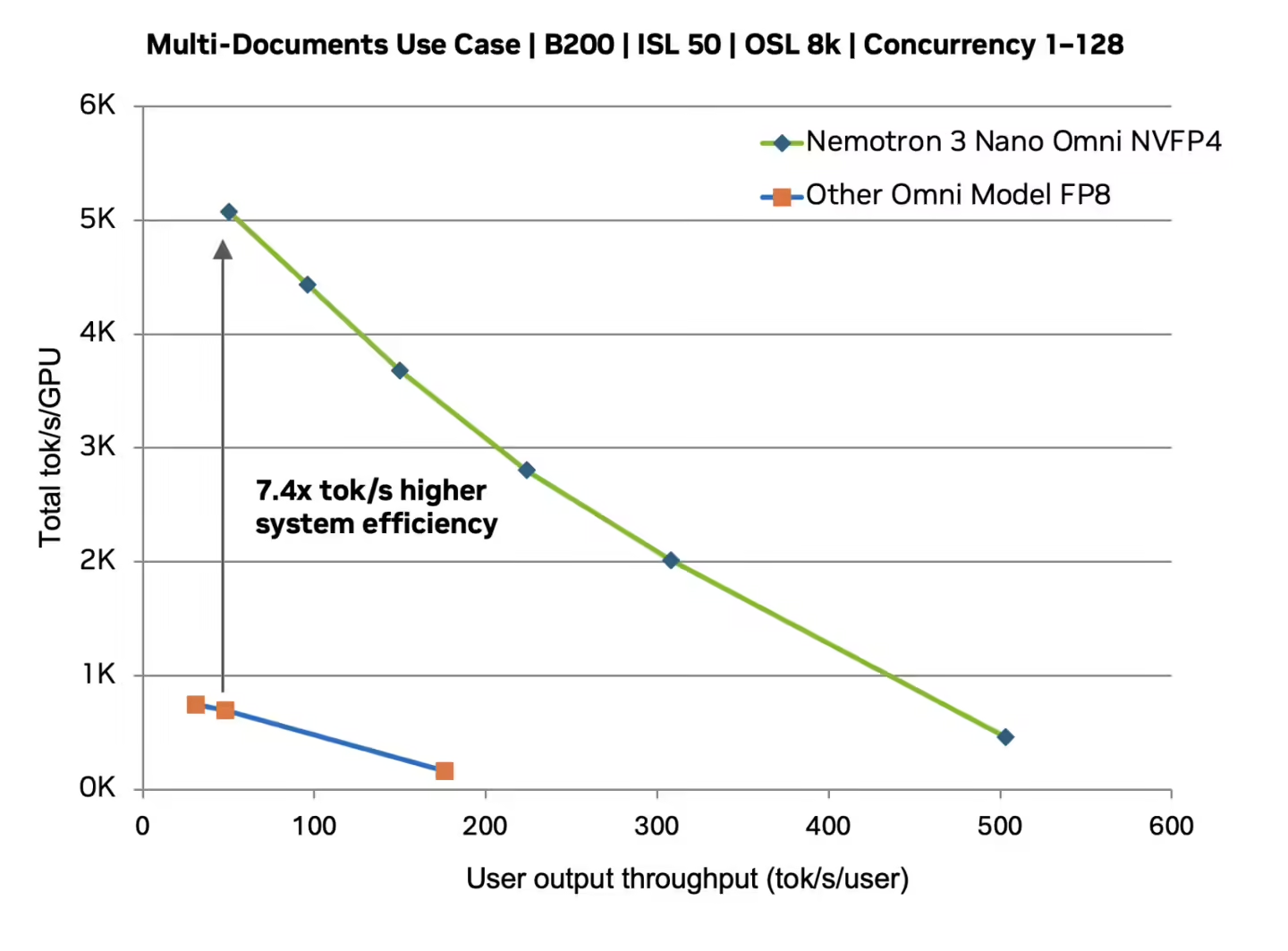

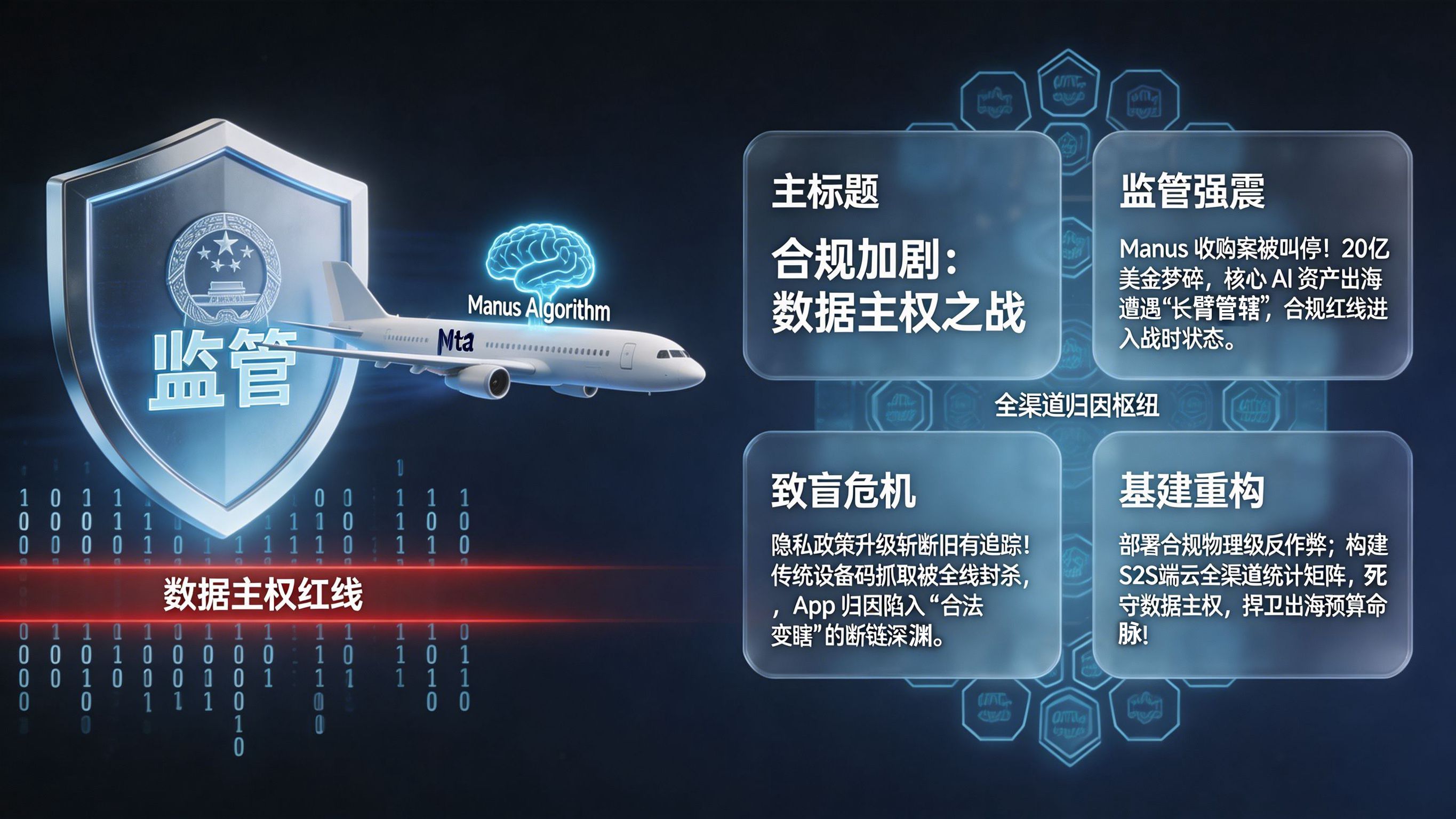

当这个星球上最赚钱的“算力军火商”决定将顶尖模型推向开源与边缘设备,整个软件分发市场的底层逻辑随之震荡。当地时间2026年4月28日,英伟达推开源模型 Nemotron 3 Nano Omni 的重磅消息引爆科技圈。这款基于 30B-A3B 混合专家(MoE)架构的全模态模型,不仅免去了单独的感知模块,更将 AI 智能体的吞吐量和推理效率疯狂提升了 9.2 倍。极低的推理成本与对 NVIDIA Jetson 等本地边缘硬件的原生支持,标志着原本高高在上的大模型算力正以前所未有的速度向终端和边缘设备倾泻(即算力下沉)。当用户的 PC、车机乃至各类泛智能终端都在本地长驻了具备“看屏、听音、执行”能力的 Computer Use Agent(计算机使用智能体)时,用户将不再手动点击屏幕上的 App 图标。面对本地 Agent 发起的极速跨端调用与参数倾泻,传统的 App 如果仍然死守着老旧的跳转协议,将被操作系统的安全沙盒无情拒之门外。App 开发者究竟该如何重构底层的通信总线,才能在这场终端革命中精准承接来自边缘 AI 的无损唤醒?

新闻与环境拆解

越过“效率提升9倍”、“登顶六大排行榜”的媒体狂欢,用技术架构的视角去透视 ,我们能深刻感知到,英伟达的刀锋已经从云端算力中心指向了端侧设备的意图主导权。

30B-A3B混合架构:算力下沉的物理基础

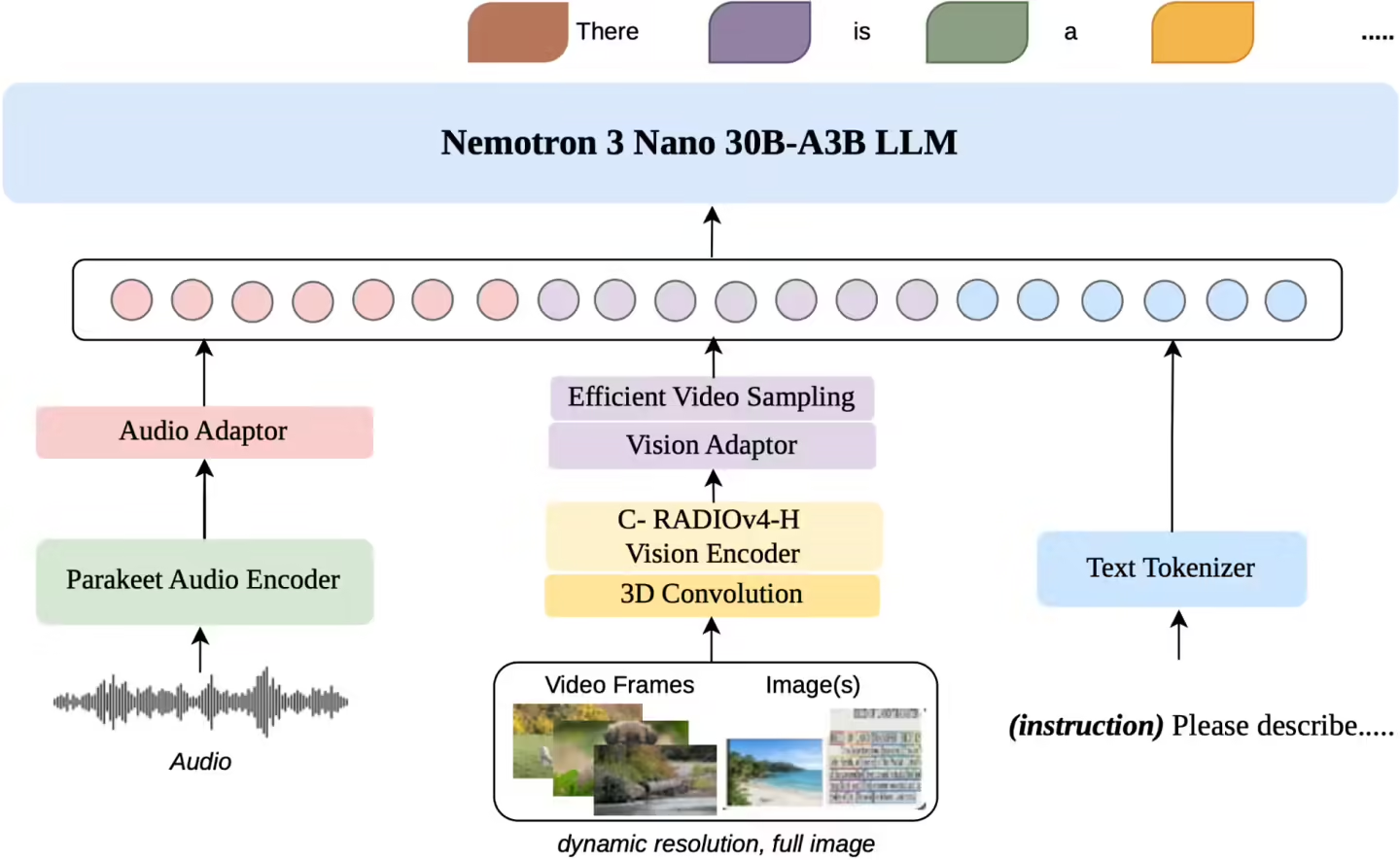

Nemotron 3 Nano Omni 的核心突破在于其极度精巧的混合专家(MoE)设计。总参数量虽达 300 亿(30B),但在实际推理中激活的参数仅有约 30 亿(3B)。这种结合了 Mamba 层(提升序列与内存效率)与 Transformer 层的创新,让内存和计算效率最高提升了 4 倍。 这意味着什么?意味着过去必须依赖庞大云端 GPU 集群才能完成的高清视频实时解析与长文档推理,现在可以直接下放到企业本地服务器、边缘计算节点甚至是高端个人终端上运行。算力的下沉,为本地级、全天候待命的 AI Agent 提供了充沛的物理弹药。

全模态融合感知:Computer Use Agent 的崛起

该模型最大的产品亮点是“统一多模态推理集成”。它摒弃了传统的“视觉-语音-语言”碎片化模型链,无论是看 1080P 的实时屏幕录像,还是听音频,都在一个“感知-行动”循环中完成。 正如 H Company 首席执行官所言,这种能力让“智能体快速解读全高清屏幕录像”成为可能。这类能够直接“看懂”用户屏幕并在底层操纵系统的 Computer Use Agent(计算机使用智能体),将彻底接管用户的操作路径。它不再需要通过云端绕一圈,而是在本地直接理解用户的所看所言,并瞬间向目标软件下达执行指令。

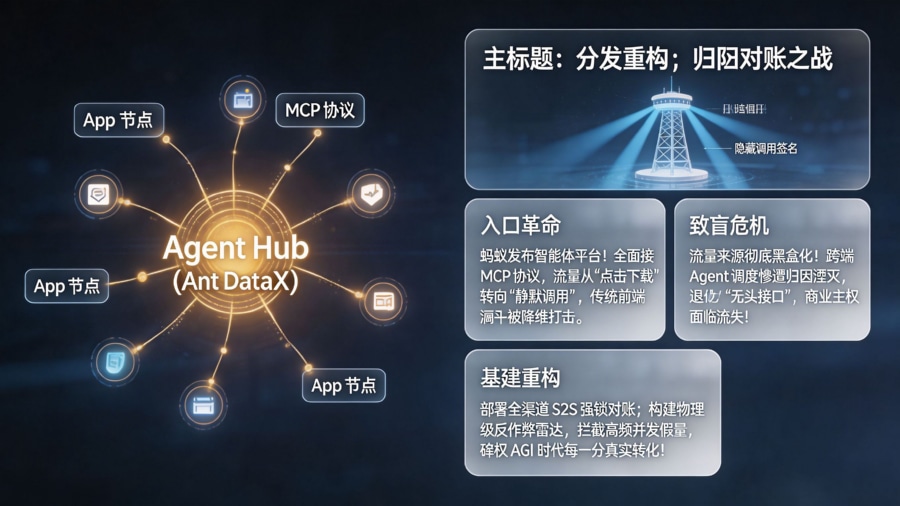

开源与生态赋能:重构应用执行层

英伟达不仅开源了模型权重,还提供了完整的端到端部署指南,支持从 NVIDIA DGX 到 Jetson 等各类边缘硬件。作为底层生态的掌控者,英伟达的战略非常清晰:通过提供最锋利的开源工具,武装全球的开发者去构建无处不在的多模态子 Agent。在这套新生态里,各类垂直 App 将被迫从“直接面向用户的流量入口”退化为“被边缘 Agent 随时调用的执行插件”。

从新闻到用户路径的归因问题

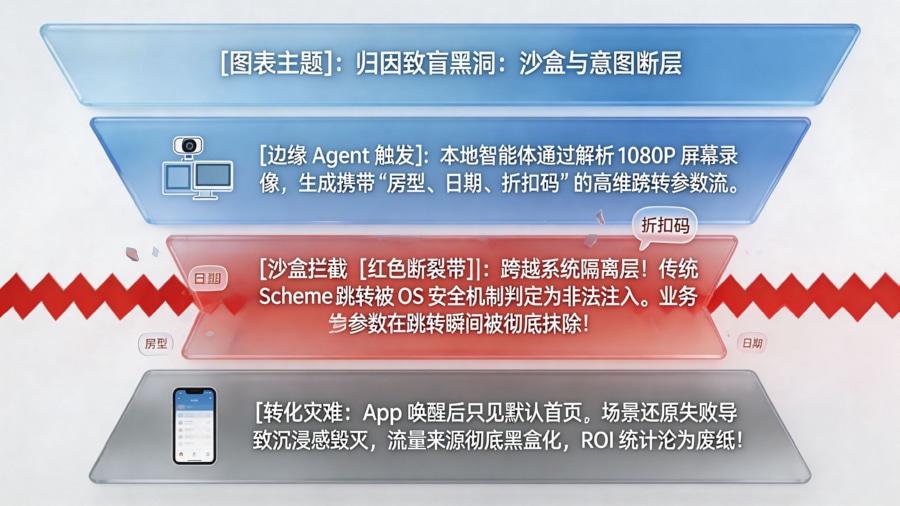

当 AI 算力下沉,本地智能体成为横亘在用户与 App 之间的超级管家,移动端与桌面端的应用跳转链路将面临空前的沙盒阻断危机。

设想这样一个近未来场景:用户正在通过智能终端播放一段旅游 Vlog,他对本地的系统级 Agent 说:“帮我把视频里出现的这家海滨酒店订下来,用我常用的那个旅游 App,定明晚的无敌海景房。” 此时,拥有视觉解析能力的端侧 Agent 瞬间锁定了酒店信息,并在后台构建了一段包含极其复杂的业务参数(如特定的酒店 ID、入住房型、日期、甚至比价后的折扣码)的跨应用拉起指令。

在这个由“意图代理”主导的自动化流程中,旅游 App 将遭遇底层技术的三重劫杀:

-

高维参数的系统级沙盒拦截:当端侧 Agent 试图用传统的 URL Scheme 将这批高维的参数流注入目标 App 时,由于是从一个系统底层进程向另一个独立沙盒进程发起调用,现代操作系统(如 iOS/Android)的安全机制会将其判定为高风险的进程越权注入。结果往往是跳转被直接拦截,或者参数被强制清洗。

-

场景断裂导致的体验毁灭:沙盒拦截的直接后果是,旅游 App 可能被生硬地拉起了,但 Agent 辛辛苦苦解析出来的“特定海景房”参数全丢了。用户面对的是一个冷冰冰的默认首页,不仅所谓的“AI 智能订房”成了笑话,App 也因此白白流失了一个高净值订单。

-

分发溯源的黑盒化:如果用户的设备上尚未安装该旅游 App,Agent 会将其引导至应用商店下载。传统的追踪机制在经历了应用商店的“黑洞”后,会彻底丢失来源标识。App 推广团队在后台根本无法区分,这个新用户是自然搜索下载的,还是由搭载了英伟达边缘大模型的智能终端导流而来的,导致跨端生态合作的对账体系全面瘫痪。

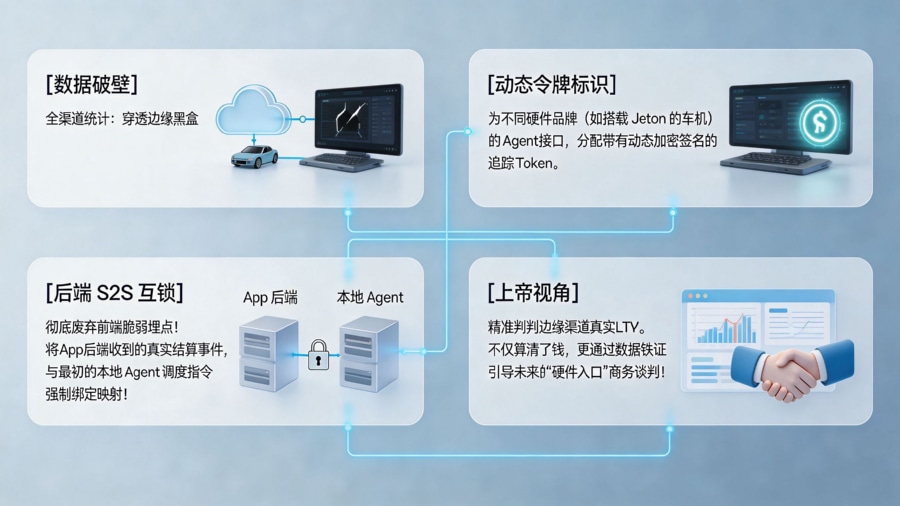

工程实践:重构安装归因与全链路统计

行业前瞻提示:随着英伟达等巨头推动大模型算力向端侧和边缘下沉,流量入口的争夺战已经打到了操作系统的最底层。openinstall 技术实验室指出,如果 App 无法在通信总线上进行升级以承接端侧 AI 的合法注入,注定将在意图交互的时代被彻底孤立。

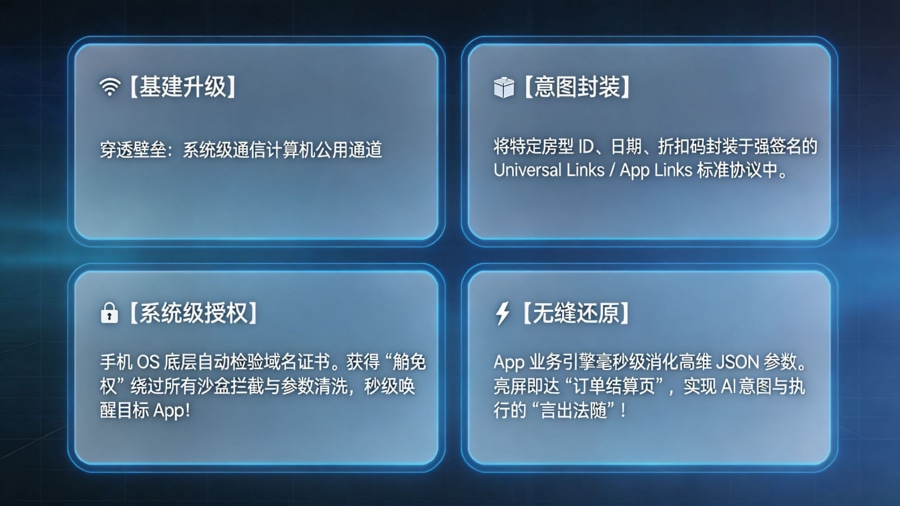

面对算力下沉引发的本地 Agent 接管危机,App 开发与增长团队必须果断抛弃脆弱的旧版跳转协议,用基于系统内核级认证的深度链接去重构跨端唤醒隧道。

部署系统级通信总线,承接 Agent 无损唤醒

-

问题:如何在极度封闭的操作系统沙盒中,确保端侧 Agent 发出的复杂意图参数(如特定商品 ID、视频时间戳)能够被目标 App 安全、完整地接收并执行?

-

做法:在全端彻底淘汰传统的网页跳转,原生部署具备最高系统级信任签名的 技术(涵盖 iOS Universal Links 与 Android App Links)。当本地的 Computer Use Agent 发起跨域流转请求时,将结构化的高维任务参数深度加密并封装于该标准链接协议中。

-

好处:这是打穿不同应用进程沙盒的合法超级高速公路。只要端侧 Agent 发起请求,系统内核层会瞬间进行强签名校验并合规放行,以毫秒级速度拉起目标 App。引擎内部直接提取并消化来自 AI 的业务参数,为用户呈现分毫不差的场景还原页面(如直接弹出已选好明晚日期的海景房结算页),实现“言出法随”的极致体验。

重构跨域中转引擎,打穿应用商店黑洞

-

问题:对于被边缘 Agent 推荐但尚未安装该应用的新用户,如何在他们经历漫长的下载安装后,依然能找回 AI 最初设定的上下文意图并精准核算渠道 ROI?

-

做法:在服务端深度集成基于系统级脱敏模糊聚类的 模块。当端侧智能体触发向应用商店的跳转指令时,云端引擎会静默留存一份带有专属动态签名的意图快照。用户冷启动 App 的瞬间,SDK 极速向云端匹配该快照,将遗失的参数重新注入内存。同时,辅以端云协同的 矩阵,将后端发生的核心变现事件与前端的 Agent 调度口令进行交叉对账。

-

好处:完美跨越了应用分发的时空断层。新用户在落地瞬间依然能精准恢复 AI 助手的推荐场景,降低流失率;同时,运营总监能依靠不可篡改的后端核销报表,清晰界定各类底层硬件或本地 Agent 带来的真实拉新转化价值,在未来的硬件预装与 API 分发合作中牢牢掌握议价权。

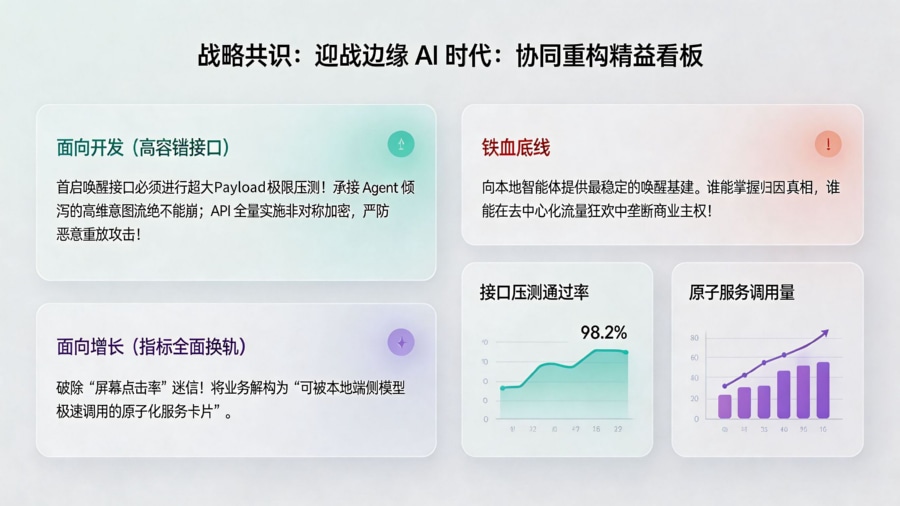

这件事和开发 / 增长团队的关系

英伟达推开源模型 吹响了算力向边缘设备总攻的号角,App 团队的战术防御圈必须立刻向底层收缩:

面向开发 / 架构

研发架构师必须面临一次严酷的“接口防弹测试”。当 App 成为被各类本地 Agent 高频调用的执行插件时,客户端的解析引擎必须具备处理超大体积 JSON 格式跨端参数的鲁棒性,主线程绝不能在承接密集倾泻的复杂指令时发生 OOM(内存溢出)。同时,所有对外开放的底层唤醒 API 必须追加极其严苛的非对称加密与动态时间戳(Timestamp)校验,严防黑产利用开源模型的底层权限,伪造虚假的本地高频唤醒指令,发起耗尽服务器资源的恶意重放(Replay)攻击。

面向产品 / 增长 / 运营

增长操盘手必须破除“流量都在云端媒体平台”的古典迷信。随着算力下沉,未来最高净值的流量将隐藏在用户的个人 AI 助理与本地硬件边缘节点中。运营团队必须深度研究如何将 App 内部的核心业务解耦为“可随时被本地端侧模型极速调用的原子化服务卡片”。在未来的多终端混战中,谁能为底层操作系统和本地智能体提供最稳定、跨端折损率最低的传参及拉起服务,谁就能成为这场去中心化流量狂欢中的最大赢家。

常见问题(FAQ)

为什么 英伟达推开源模型 Nemotron 3 Nano Omni 会对终端分发产生巨大影响?

因为这款模型采用了 30B-A3B 混合专家架构,在保证极致推理精度的同时,极大地降低了内存和计算开销,使得大模型不仅限于在云端运行,更能被广泛部署在企业边缘节点和高性能本地终端上。其原生支持视频、音频、图像多模态解析的能力,极大催生了“看屏、听音”的本地智能体(Agent)的爆发。算力的下沉意味着流量分发权将从中心化的应用分发商店,转移到本地硬件与智能体手中。

“算力下沉”为什么会导致传统 App 的跳转面临“沙盒阻断”?

在过去,应用间的跳转多数依赖于简单的 URL Scheme,指令相对简单。而在“算力下沉”的智能体时代,本地 Agent 为了替用户完成复杂的自动化闭环任务(如直接定好特定日期的酒店房间),会在后台向第三方 App 发送极其高维和庞大的业务参数流。现代操作系统出于安全防御,会将被判定为复杂越权注入的传统 Scheme 跳转拦截在沙盒之外,导致参数丢失、场景还原失败。

App 团队如何利用深度链接(DeepLink)技术破局?

深度链接(如 iOS 的 Universal Links 和 Android 的 App Links)是基于操作系统内核级域名证书信任的底层跳转标准。与容易被拦截的 Scheme 不同,深度链接拥有系统级的最高放行权限。App 开发者通过部署该技术,可以确保由端侧 Agent 发出的复杂加密参数在经过操作系统时不仅不会被清洗,还能实现毫秒级的无缝拉起,直接在 App 内还原业务场景,彻底消除 AI 意图与最终执行之间的摩擦力。

行业动态观察

回望这场由英伟达 Nemotron 3 Nano Omni 开源引发的行业地震,我们见证了“算力霸主”如何用极其冷酷的架构效率,将 AI 的战火从遥远的云端算力中心烧到了每一台本地终端的芯片上。

openinstall运营团队

openinstall运营团队 2026-04-29

2026-04-29 17

17

闽公网安备35058302351151号

闽公网安备35058302351151号