DeepSeek突发11小时宕机:流量洪峰下,App归因系统顶得住吗?

3月29日夜间至30日上午,AI大模型服务商DeepSeek突发持续近12小时的大规模宕机,网页与App端全面瘫痪。这场由大量探测流量与用户重试引发的“雪崩效应”,为所有互联网产品敲响了警钟。对于App开发与增长团队而言,当斥巨资打造的营销活动或裂变拉新迎来“流量洪峰”时,承载着核心转化数据的App归因系统,真的顶得住吗?

新闻与环境拆解

根据相关技术复盘与的报道,此次DeepSeek发生长时间中断的核心灾区大概率并非底层模型本身,而是前端承接访问的 Web Chat Service(网页和APP聊天入口层)。

在某个时间窗口内,大量为了验证新版本(网传V4)的围观流量集中涌入。这类流量伴随着高频的刷新、重登、重建会话。这导致入口网关和鉴权服务率先承压,会话元数据读取让共享缓存和数据库连接池被占满。当页面卡顿,用户出于本能不断刷新重试,系统一边处理旧流量,一边承接剧增的新重连请求,最终导致入口层被彻底压穿。这一事件深刻表明:在突发大流量面前,计算节点的弹性扩容往往跟不上“有状态服务”的崩溃速度,交付系统的稳定性远比单纯的功能指标更具决定性。

从新闻到用户路径的归因问题

DeepSeek入口层的崩溃逻辑,在App的买量分发与裂变增长场景中几乎每天都在重演。对于一款App而言,其“入口层”不仅是自家的服务器,更是负责承接所有外部广告点击、社交分享跳转的“渠道归因系统”。

当App进行大规模买量投放,或是某次KOL带货引发社交平台病毒式裂变时,往往会在极短时间内产生海量的点击请求。如果App依赖的是承载能力薄弱的自建归因服务,海量并发请求会瞬间击穿网关,导致链路发生灾难性断层。具体表现为:用户点击广告或分享链接后,页面陷入漫长的白屏等待;原本应该顺滑跳转至应用商店的动作因超时而阻断;更致命的是,当用户最终几经波折下载App后,由于归因服务器宕机,携带的渠道参数、邀请码等核心数据彻底丢失。这不仅极大损害了用户体验,更让增长团队的买量ROI变成一笔难以追溯的糊涂账。

工程实践:重构安装归因与全链路统计

为了避免在流量高峰期重蹈“入口堵死”的覆辙,开发与增长团队必须在工程架构上将归因系统与核心业务系统进行解耦,并依赖经过海量并发验证的高可用机制。

高并发下的参数无损传递

问题: 突发流量下,大量的并发读写会导致数据库连接池耗尽,用户在点击链接到最终安装唤起的过程中,动态参数极易丢失。 做法: 采用高可用的分布式架构与边缘节点加速,将设备指纹生成与参数匹配逻辑前置。通过成熟的技术,将渠道ID、邀请人ID等核心信息在用户点击瞬间进行高强度并发缓存,并在用户首次打开App时极速下发匹配。 带来的好处: 无论流量洪峰多么凶猛,都能确保每一个点击与最终安装精准绑定,彻底告别“流量爆了但数据全丢”的尴尬局面,实现真正的免填邀请码裂变。

极速响应的动态路由与场景还原

问题: 流量激增导致重定向网关响应缓慢,用户在等待跳转的过程中流失,且无法在安装后回到原生场景。 做法: 摒弃繁重的中心化跳转逻辑,利用优化的(DeepLink)机制,在用户点击瞬间实现本地化或轻量级的意图判断:已安装则直接拉起App并恢复对应页面,未安装则无缝引导至各大应用商店。 带来的好处: 大幅缩短跳转链路,降低因服务器响应慢带来的用户跳出率,确保高并发下的流量承接转化率依然坚挺。

海量数据的全渠道统计与对账隔离

问题: 当数以万计的渠道同时发力时,统计数据延迟、丢失,导致业务团队无法实时调优投放策略。 做法: 引入独立第三方的基建,利用流式计算引擎对多维度流量进行实时聚合与反作弊清洗。 带来的好处: 即使在极端峰值下,也能为增长团队提供秒级延迟的渠道对账报表,确保每一分预算的投入产出都清晰可见。

注:本文探讨的针对亿级极高并发场景下的“物理级边缘节点私有化隔离归因架构”属于对未来超大型分发趋势的前瞻性技术延展与思考。目前此类高度定制化的抗洪峰极速链路尚未作为标准功能全量实现,如 App 开发者有相关高阶业务需求,欢迎联系 openinstall 客服团队进行技术探讨或共同定向研发拓展。

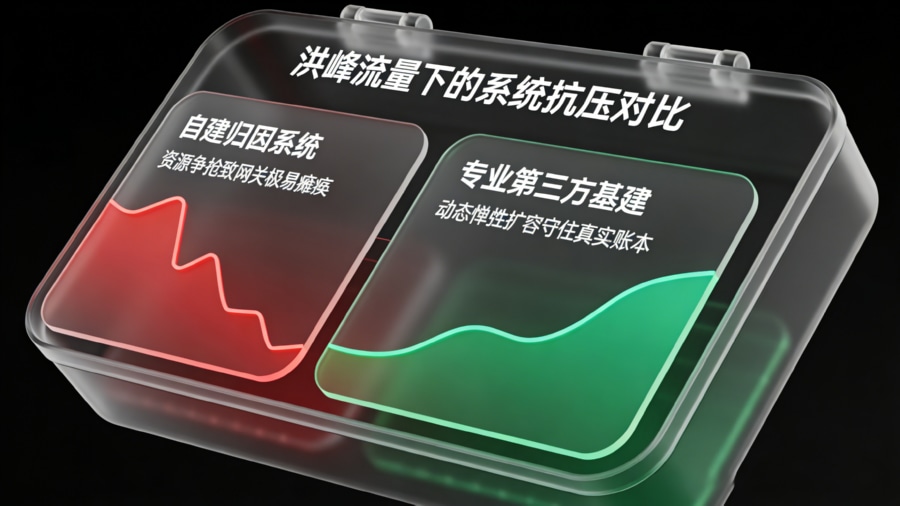

这件事和开发 / 增长团队的关系

对开发与架构团队而言,DeepSeek的教训证明了“不要把所有鸡蛋放在一个篮子里”。App的核心服务器应专注于处理核心业务逻辑(如交易、游戏对战、AI推理),而诸如点击追踪、设备指纹生成、参数归因等高并发、高杂讯的“脏活累活”,理应剥离出去,交由专业的第三方归因基建来扛住第一波流量冲击,从而保护主营业务数据库的绝对安全。

对产品与增长团队而言,营销活动的成功与否,往往不取决于内容有多好,而取决于“管道有多宽”。在制定大型投放或裂变策略时,必须将归因系统的稳定性纳入核心考量指标。如果无法保障场景还原的顺畅和渠道统计的精准,再庞大的流量洪峰也只是无效的服务器账单,无法沉淀为真实的用户资产。

常见问题(FAQ)

为什么流量集中爆发时自建归因系统容易崩溃?

自建归因系统通常与App的主线业务共用部分数据库或网关资源。当面临类似裂变营销的突发流量时,海量的设备特征提取、短时间内的上下文会话创建以及并发的读写请求,会瞬间耗尽系统的连接池,导致整个服务链条因资源争抢而陷入瘫痪。

流量洪峰对深度链接跳转成功率有什么影响?

在服务器过载的情况下,深度链接网关的响应延迟会急剧增加。这不仅会导致用户在点击后看到长时间的空白页面,还可能触发各大浏览器或系统的超时保护机制,直接阻断向应用商店或App的跳转路由,令原本高意愿的用户大量流失。

面对突发流量,如何保障买量数据的准确性?

最稳妥的策略是接入具备动态扩容能力和海量并发处理经验的第三方服务。通过将点击上报、防作弊过滤与设备指纹比对等环节交由专业基建处理,可以有效避免因单一节点卡顿导致的数据漏报与错报,从而在洪峰中守住真实的数据账本。

行业动态观察

DeepSeek的创纪录宕机和Sora的黯然退场,正在向整个科技互联网行业传递一个明确的信号:单纯的技术炫技与模型跑分时代正在过去,商业交付的可靠性与稳定性将成为下一阶段竞争的胜负手。这同样适用于App分发生态。

openinstall运营团队

openinstall运营团队 2026-03-31

2026-03-31 164

164

闽公网安备35058302351151号

闽公网安备35058302351151号