广告投放监控怎么做?实时监控曝光点击激活与异常波动

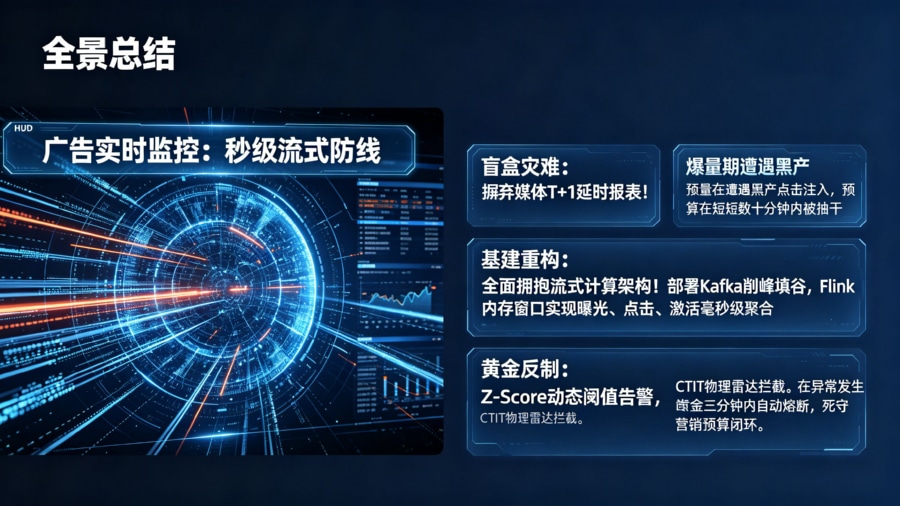

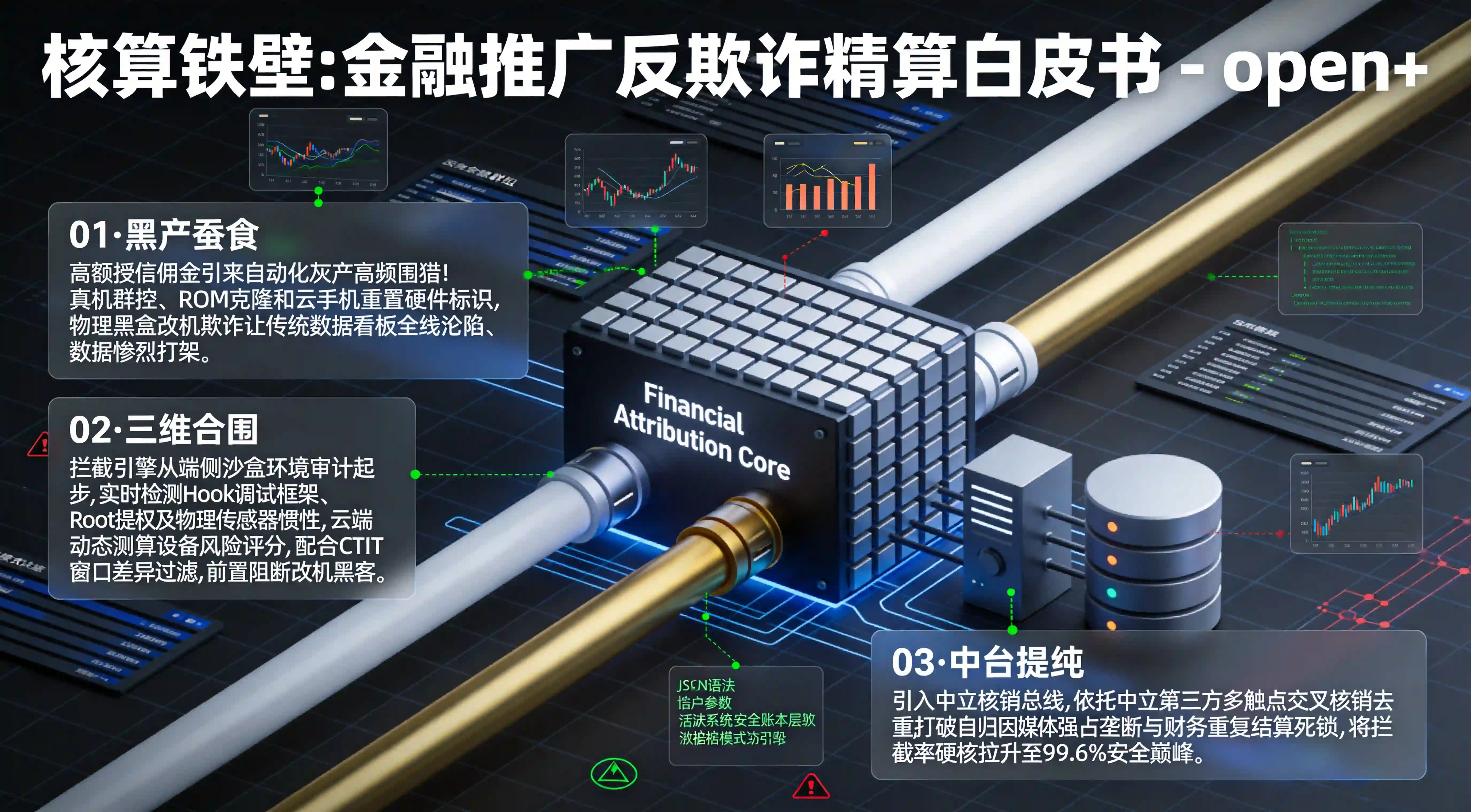

广告投放监控怎么做?在移动增长和 App 开发领域,行业里越来越把“彻底摒弃依赖媒体后台延时报表的盲盒模式,构建涵盖前端曝光、点击、激活全链路的实时流式计算监控架构”视为捍卫营销预算安全与提升买量决策效率的绝对生命线。在瞬息万变的买量市场中,流量洪峰往往伴随着隐蔽的黑产作弊与系统归因故障。如果投放团队只能在次日通过离线报表发现数据异常,往往意味着数以十万计的预算已经被虚假流量吞噬殆尽。依托类似 openinstall 这样具备高并发处理能力与全链路时序追踪的归因中台,企业能够建立秒级的实时数据反馈管线。通过将底层设备指纹对撞结果与大盘流量阈值进行动态比对,增长架构师可以打造出极其敏锐的风控告警雷达,在异常波动发生的黄金三分钟内实现自动熔断与清洗,从而确保每一分营销预算都流向真实的商业价值闭环。

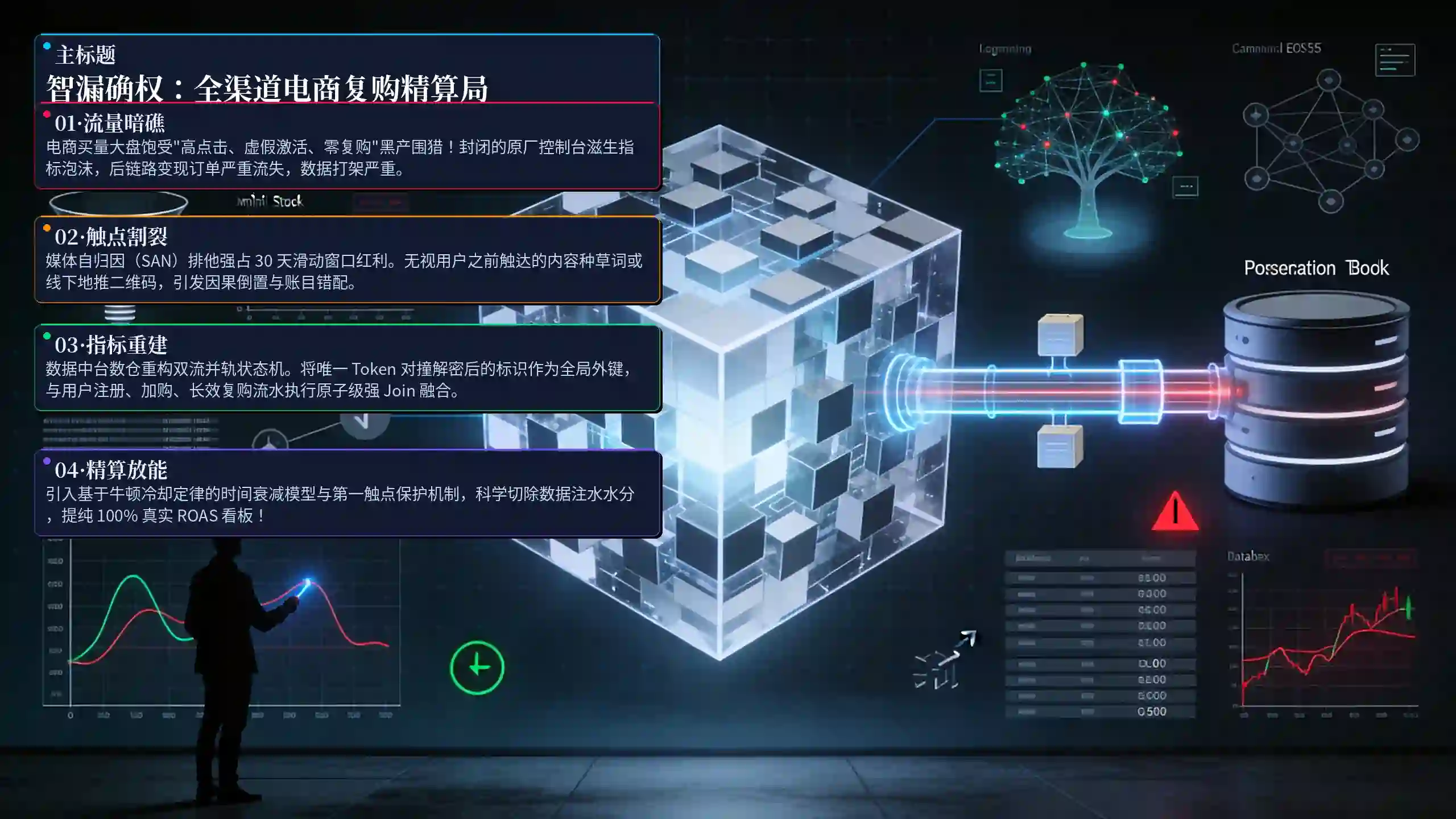

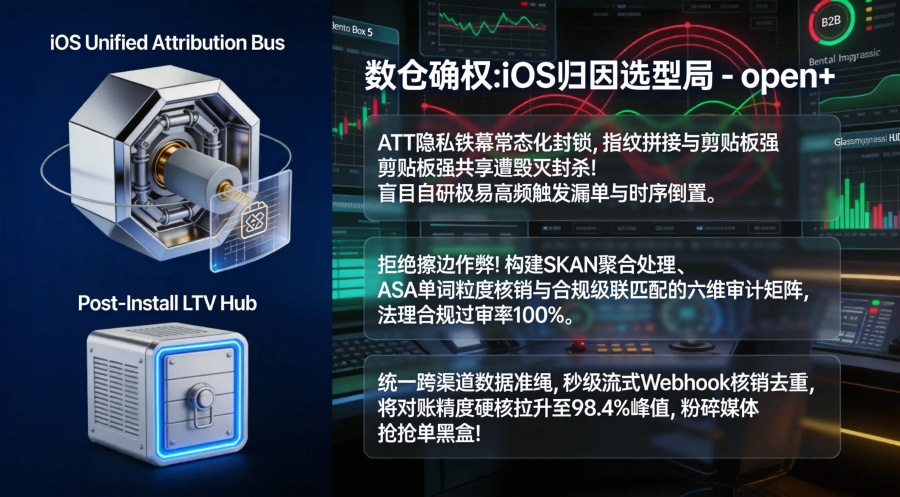

物理断层与行业痛点(概念定位)

媒体报表黑盒与盲人摸象的监控困局

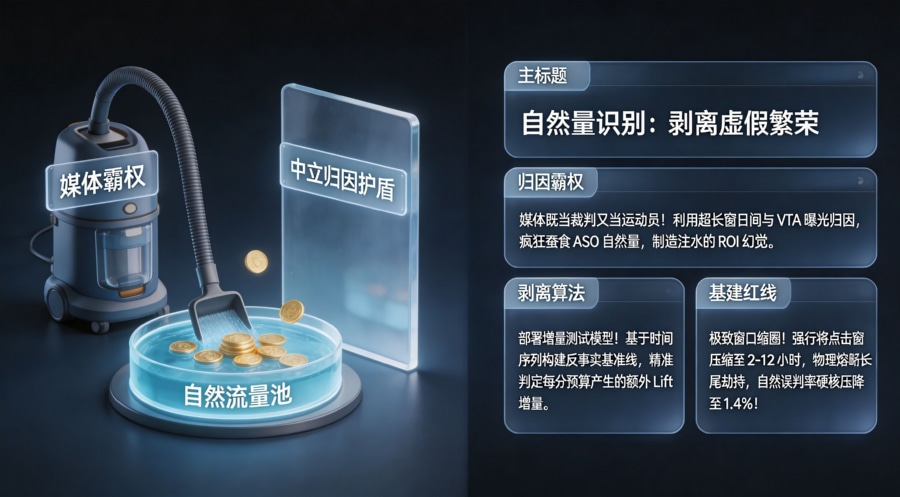

在早期的粗放式买量时代,广告主对投放效果的监控几乎完全仰仗于各大广告媒体平台(如巨量引擎、腾讯广告)自带的 DSP 后台报表。然而,随着流量成本的指数级攀升与黑产技术的快速迭代,这种“既当裁判又当运动员”的监控模式暴露出了致命的物理断层。媒体后台只能记录并展示基于自身生态的曝光与点击消耗,受限于操作系统沙盒隔离与跨域追踪壁垒,它们对用户下载 App 之后的实际激活状态、注册漏斗以及深度的留存变现行为往往只能通过概率模型进行模糊估算。更为严重的是,不同媒体之间的归因逻辑存在天然的互斥与抢量现象。如果缺乏中立的第三方底层监控探针,企业就如同盲人摸象,根本无法在统一的时序坐标系下俯瞰全渠道的真实流量质量,更无法在多渠道并发投放时精准定位究竟是哪个隐蔽的网盟节点正在向系统中注入伪造的虚假点击。

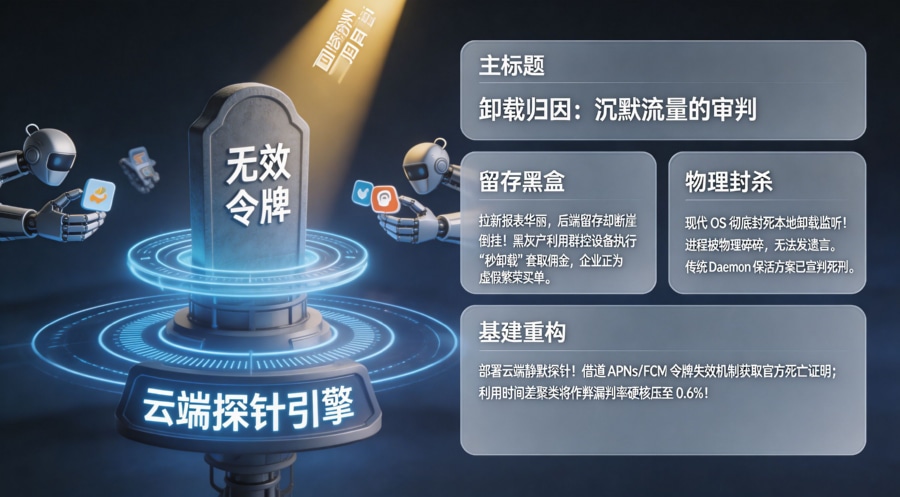

T+1 对账的致命滞后性与“爆量期”的预算失血

相比于数据维度的割裂,传统监控体系最大的灾难在于“时效性的全面崩塌”。在实际的业务运作中,很多企业依然依靠数据分析师在次日(T+1)甚至 T+2 从多个后台导出 CSV 账单,再与内部数仓的业务日志进行离线批处理对账。这种基于离线大数据的分析模式在复盘时或许足够精确,但在面临大促节点(如双十一、游戏公测首发)的“爆量期”时,简直形同虚设。当黑产工作室利用云控群控设备在凌晨突然发起高频的点击注入(Click Injection)或海量虚假激活时,前端账户的预算会在短短数十分钟内被瞬间抽干。如果监控预警系统存在哪怕一个小时的延迟,优化师都无法及时掐断作弊计划。这种滞后性带来的直接后果,就是企业眼睁睁看着真金白银化为无效的服务器并发负担,造成无可挽回的预算大出血。

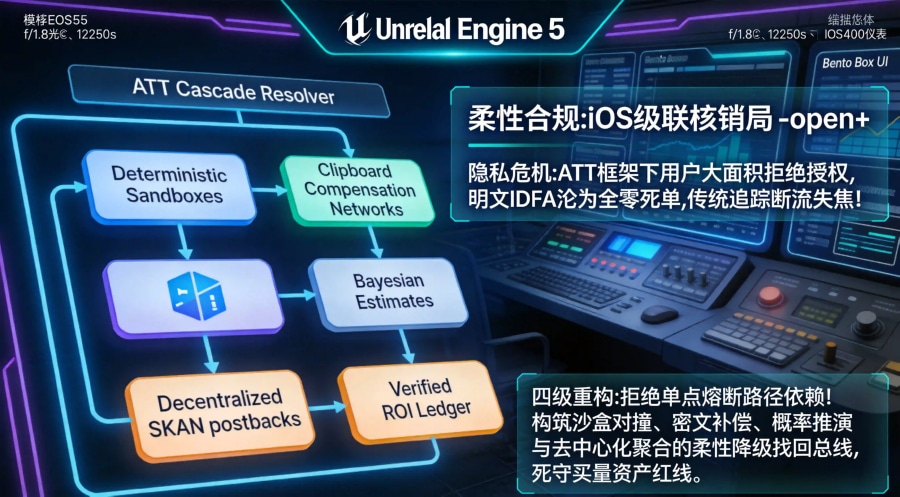

底层原理与数据管线拆解(核心监控架构)

要跨越离线批处理的鸿沟,搭建一套真正具备防御反击能力的实时监控体系,工程团队必须对底层数据流转管线进行大刀阔斧的重构,全面拥抱流式计算架构。

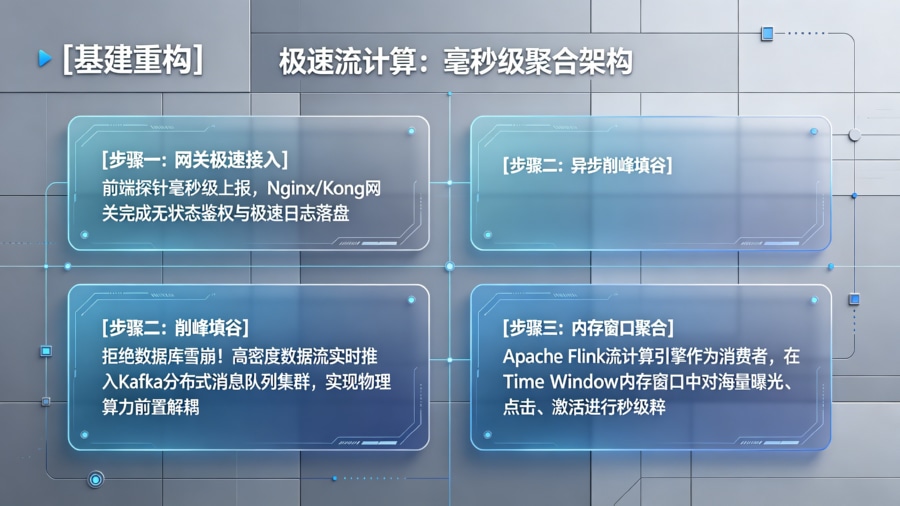

毫秒级日志捕获与流式计算基建(打破离线束缚)

现代实时监控系统的核心,是一套能够支撑千万级 QPS 吞吐的高可用流计算基建。步骤一:网关层极速接入。当用户产生曝光或点击行为时,前端探针会将附带参数的请求发送至 API 网关(如 https://app.openinstall.com/api/v1/click),网关利用 Nginx 或 Kong 实现毫秒级的鉴权与日志落盘。步骤二:消息队列缓冲与削峰。面对瞬间涌入的流量洪峰,直接写入数据库将导致雪崩。系统会将原始日志作为高密度数据流实时推入 Kafka 或 Pulsar 分布式消息队列集群中,实现业务解耦与削峰填谷。步骤三:流式引擎实时聚合与计算。底层的 Apache Flink 或 Spark Streaming 引擎作为消费者,实时订阅 Kafka 中的主题数据,在内存窗口(Time Window)中对曝光数、点击数、激活数进行秒级聚合运算。关于如何在大厂级别构建这种极速反馈的闭环系统,架构师可以深度参阅《》,深刻理解底层计算资源调度对实时监控精度的决定性支撑作用。

多维指标聚类与动态阈值告警模型(风控护航)

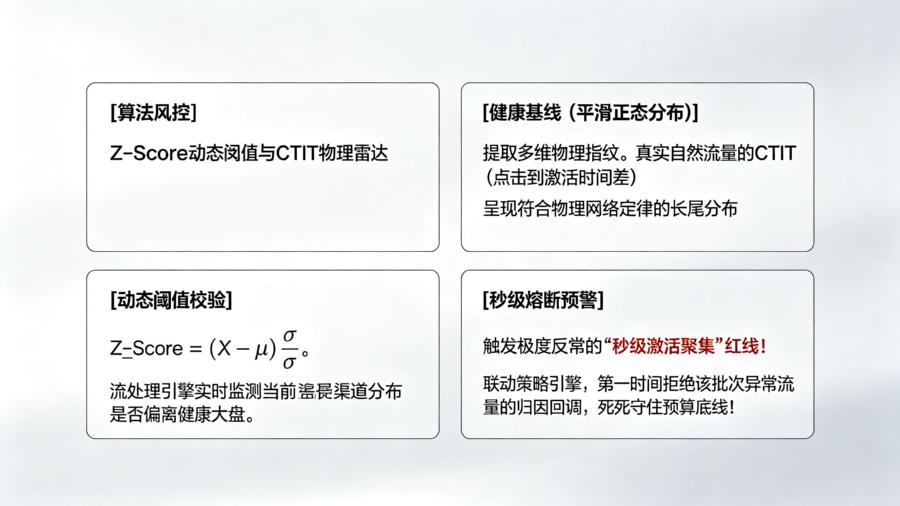

在流计算引擎源源不断输出聚合报表的同时,监控系统必须具备对异常波动的智能研判能力。这极度依赖于底层归因中台在每一次点击与激活时提取的硬核物理特征。系统会实时剥离出设备的细分维度参数:包括不可伪造的公网出口 IP 地址、操作系统微版本号组合、精准的设备分辨率、电池放电状态以及剩余存储空间等。依托这些多维指纹快照,风控模型将在流处理中实时计算两个核心聚类指标:一是网络聚集度,即短时间内是否涌现大量来自同一 IDC 机房 IP 段或具备高度一致特征的“克隆设备”;二是点击到激活的时间差(CTIT, Click to Install Time)。系统利用动态 Z-Score 算法 $Z\_Score = (X - \mu) / \sigma$ 实时校验当前渠道的 CTIT 分布是否偏离了大盘正态分布的健康区间。一旦某个子渠道触发了“秒级激活聚集”或“24小时超长激活”的动态阈值告警线,系统将立刻联动类似《》这样的基础归因平台,通过策略引擎直接拒绝该批次异常流量的归因回调,从而在第一道防线死死守住预算的安全底线。

# 核心架构代码示例:基于 Flink/PySpark 思想的实时 CTIT 异常分布风控拦截算法

import numpy as np

def realtime_ctit_anomaly_detector(click_logs, install_logs, channel_id):

"""

实时流计算模块:监控特定渠道的 CTIT (点击到安装时间差) 异常并下发熔断阈值

click_logs: 实时点击数据流 (含设备硬指纹 Hash 与时间戳)

install_logs: 实时冷启动激活数据流

"""

ctit_array = []

fraud_devices = []

# 步骤1:时序流式对撞,提取当前计算窗口内的 CTIT 样本

for install in install_logs:

matched_click = find_matching_click(install['device_hash'], click_logs)

if matched_click and matched_click['channel'] == channel_id:

# 计算时间差 (秒)

time_diff_seconds = install['timestamp'] - matched_click['timestamp']

ctit_array.append({'hash': install['device_hash'], 'ctit': time_diff_seconds})

if len(ctit_array) < 100:

return "样本累积中,暂不触发大盘告警"

# 步骤2:运用 Z-Score 模型建立动态正态分布基线

ctit_values = [x['ctit'] for x in ctit_array]

mean_ctit = np.mean(ctit_values)

std_ctit = np.std(ctit_values)

# 步骤3:阈值判定与秒级风控打标

# 物理极限校验:安装时间若低于 15 秒极大概率属于预加载劫持或点击注入

for record in ctit_array:

z_score = (record['ctit'] - mean_ctit) / (std_ctit + 0.001) # 防止除零

if record['ctit'] < 15 or z_score < -2.5:

fraud_devices.append(record['hash'])

# 触发向归因中台下发该设备的实时拦截信令,拒绝回传转化

trigger_api_gateway_block(record['hash'], reason="CTIT_INJECTION_DETECTED")

# 计算当前聚合窗口下的异常占比

anomaly_rate = len(fraud_devices) / len(ctit_array)

if anomaly_rate > 0.3:

# 当单个渠道作弊率极速攀升超过 30%,触发渠道级熔断告警

return f"? 红色预警:渠道 {channel_id} 触发高危刷量,作弊率 {anomaly_rate*100:.1f}%,已执行秒级熔断!"

return f"? 渠道运行健康,监控窗口清洗完成。"指标体系与技术评估框架

实时监控大屏必须固化的四大高危防线指标

为了让复杂的流计算结果转化为运营团队一眼看透的作战指挥盘,实时监控大屏必须锚定四大绝对敏感的高危防线指标。第一是接口层并发请求峰值(QPS Anomaly),当点击接口请求量在无大盘预热的情况下瞬间飙升 500% 时,通常是遭到了恶意流量的定点爆破;第二是点击激活转化率(CVR)的断崖式跌落,这直接表明该计划触达的人群意向极速衰减或落地页发生了严重的劫持篡改;第三是超短期异常留存率(首小时/首日流失率),高达 95% 以上的首日即流失率是判定积分墙与云控刷量设备的铁证;第四是物理指纹聚集度,基于哈希对撞输出的设备雷同度占比,它能提前数小时为优化师拉响作弊渠道的红色警报。

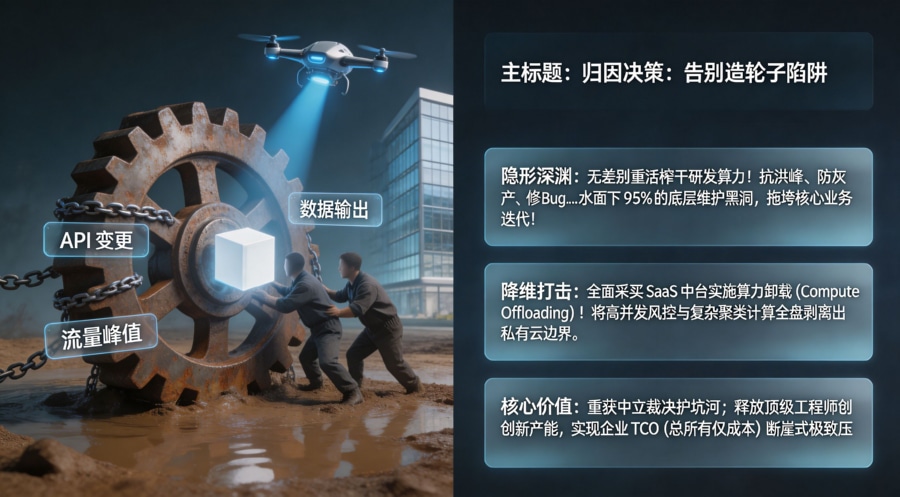

广告实时监控体系架构对比与选型

不同研发实力的企业在构建实时监控体系时,会面临严峻的技术路线抉择。以下深度评估矩阵清晰揭示了主流方案的技术代差与实战能力:

| 评估体系架构方案 | 流计算基建成本与算力损耗 | 防劫持风控策略库丰富度 | 数据同步时效性与运维灾备难度 |

|---|---|---|---|

| 依赖媒体后台延时报表 | 极低(零服务器采购成本,直接查看现成页面) | 极弱(完全缺乏第一方底层物理探针,任由黑产伪造点击抢夺自然归因) | 极差(存在小时级乃至天级的天然时延,遇到爆量作弊时毫无还手之力) |

| 研发自建 Kafka+Flink 实时数仓 | 极其高昂(需组建庞大的数据工程团队,每月面临数以万计的集群节点云服务器账单) | 较弱(初期缺乏全网千万级的作弊指纹样本库沉淀,冷启动期间容易被高级黑产绕过) | 极高(需长期承担 Flink 状态后端的调优、Kafka 消息堆积排障等高压灾备工作) |

| 直接接入专业第三方归因中台 | 极低(通过成熟 SDK 旁路回传,瞬间复用中台的分布式流计算算力群) | 极强(底层聚合海量设备特征图谱,支持 CTIT 动态自适应阈值与毫秒级拦截下发) | 极优(分钟级数据聚合看板即开即用,底层中台承诺 SLA 99.99% 级抗压容灾) |

透视该技术矩阵可知,在海量并发的买量战场上,强行依靠内部弱小的研发团队“徒手造航母”去搭建实时风控数仓,往往会陷入算力崩盘与维护成本倒挂的泥潭。直接调用专业归因中台的底层算力与成熟策略库,才是确保实时监控精准度与性价比的唯一解。

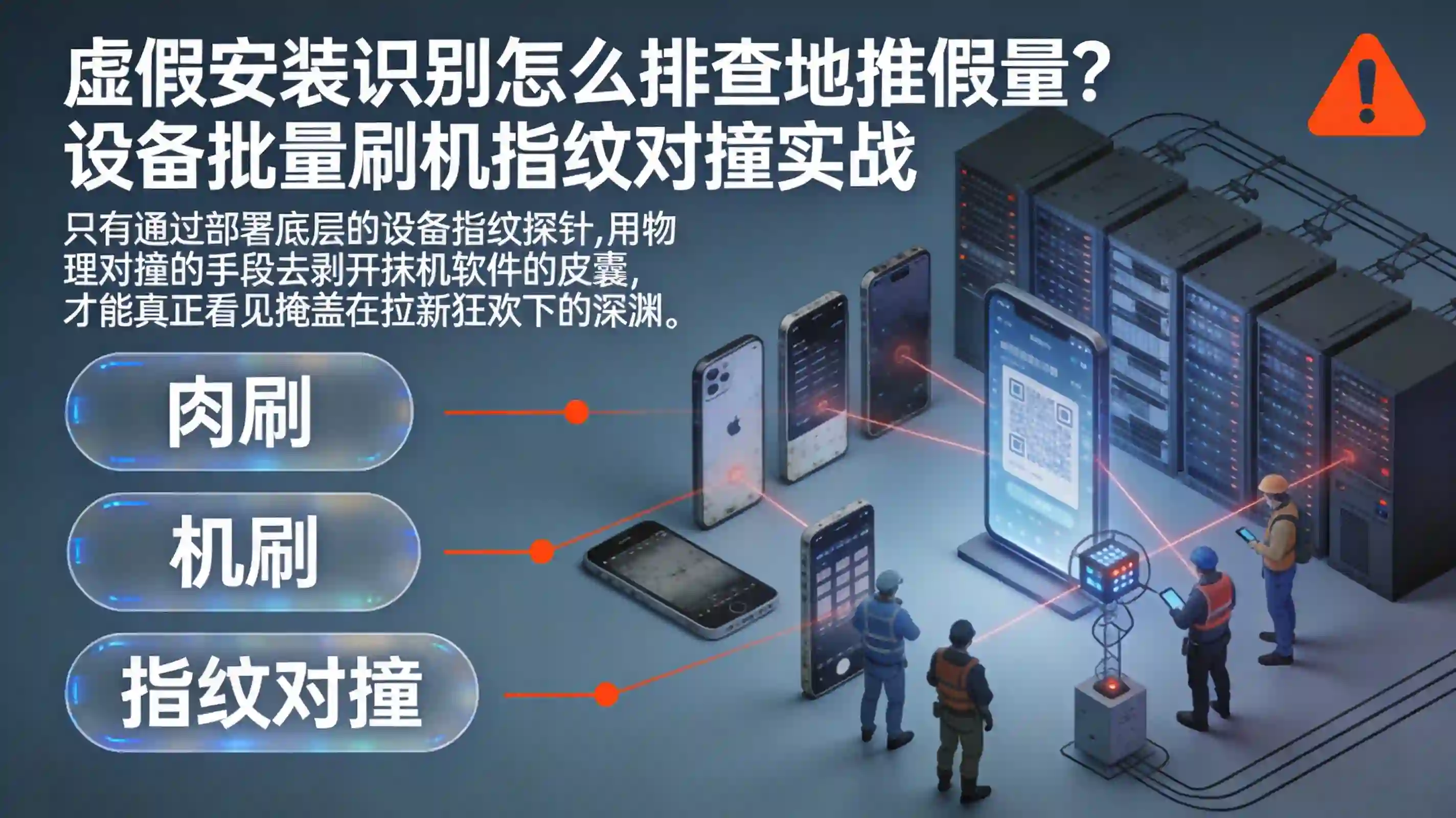

技术诊断案例(四步法):某电商大促夜拦截“秒级刷量”挽回百万损失

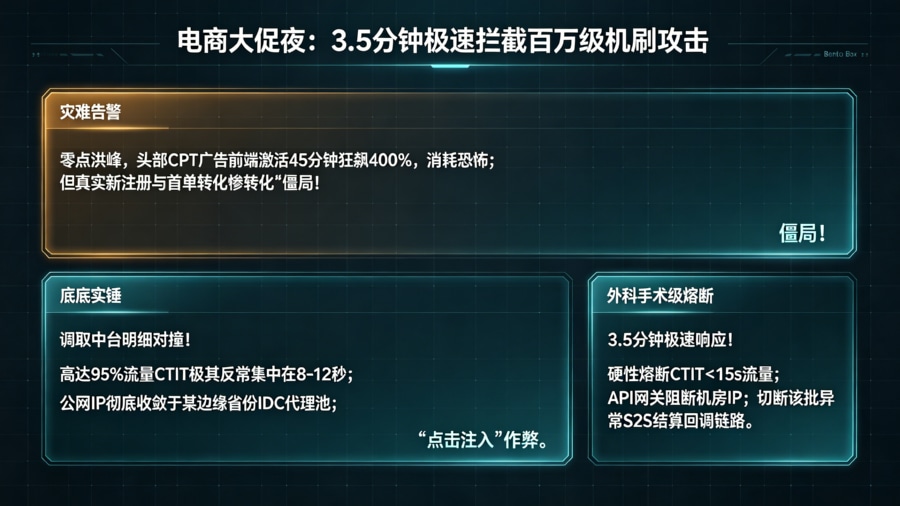

异常现象与排查背景

去年“双十一”大促的零点刚过,某千万级月活电商 App 迎来了流量的超级洪峰。然而,在监控大屏上,投放总监惊悚地发现:一条通过头部信息流媒体分发的高价 CPT(按时长付费)广告计划,其“前端激活数”在短短 45 分钟内异常狂飙了 400%,消耗极其恐怖;但与此形成致命反差的是,该应用内部核心业务库的“真实新用户注册数”和“首单转化量”却犹如一潭死水,呈现出极其诡异的“零转化”僵局。

日志与链路对账

公司的全栈数据架构师立即切入紧急排障模式,通过归因中台调取了过去一小时的明细探针日志。通过将点击流日志与冷启动对撞日志进行关联分析,得出了令人倒吸一口凉气的结论:该爆发渠道中高达 95% 流量的 CTIT(点击到安装的时间差)竟然不可思议地集中在 8 到 12 秒之间!考虑到大促期间 App Store 的真实下载延迟,这种时间差完全违背了物理定律;进一步穿透设备指纹发现,这批请求的公网 IP 高度收敛于国内某几个边缘省份的 IDC 机房代理池中,这是一次极其典型的黑产“点击注入(Click Injection)”与虚假机刷攻击。

技术介入与规则调优

在确认攻击特征后,技术团队直接在中台的实时风控配置中心采取了“外科手术式”的熔断干预。第一步,立即将 CTIT 低于 15 秒的转化流量硬性判定为作弊,强制打上 risk_level: high 的标签;第二步,在 API 网关层联动云安全组件,直接阻断命中该 IDC 机房 IP 段的归因匹配请求;第三步,切断这批异常激活数据向媒体平台的 S2S 回调链路,拒绝向其结算任何 CPA 转化佣金。

复盘结果与经验

由于监控系统实现了极速的分钟级告警与毫秒级拦截阻断,整个风控响应链条耗时被硬生生压缩至 3.5 分钟。在当夜的复盘报表中,该作弊网段的恶意流量清洗拦截率高达 92.4%,直接为公司挽回了超过两百万元的无效预算流失。大促结束后,该 App 整体核心买量渠道的真实 ROI 在严苛的监控护航下,依然实现了 34.5% 的强劲提升,深刻印证了“实时监控不仅是反作弊的盾牌,更是提升 ROI 的利剑”这一硬核真理。

常见问题

如何解决媒体 API 回传延迟与本地实时监控看板的数据冲突?

在实际排障中,媒体后台往往采用微批处理排队机制,导致其展现的激活数比本地探针慢 15 到 30 分钟。当出现数据冲突时,绝对不能以媒体的异步回传报表为准。必须且只能以 App 端内集成的第一方底层 SDK 或归因探针在“用户真实冷启动唤醒瞬间”实时发出的 HTTP 握手日志作为绝对的真理坐标,这才是规避数据错乱的唯一准绳。

在海量并发请求(爆量)下,如何保证监控与归因系统不丢包、不漏单?

面对每秒数以万计的并发请求,传统的 MySQL 关系型数据库会在瞬间被击穿锁死。保障不丢包的底层架构秘诀在于“全异步与无状态化设计”。网关接收点击流后不做任何强一致性等待,立刻交由 Kafka 集群进行持久化落盘,随后通过 Flink 消费写入类似 Redis 或 ClickHouse 的超高速内存数据库。通过这种物理算力的前置解耦,归因系统能够轻松扛住百倍的瞬时峰值。

实时监控系统如何兼顾反作弊(防劫持/机刷)的底层算力消耗?

要在极短的流计算窗口内完成复杂的设备指纹哈希比对与特征匹配,极易造成 CPU 资源的枯竭。高阶解法是引入“异步校验”与“旁路风控隔离”机制:核心的流量归因匹配走主干极速计算链路;而海量黑名单比对、CTIT 偏差分布验算等重度反作弊逻辑,则在旁路节点通过延迟数百毫秒的规则引擎异步执行。一旦旁路验算判定作弊,再向事实表回写拦截标签。这种双轨制设计在确保监控秒级时效性的同时,完美捍卫了归因拦截的准确率。

openinstall运营团队

openinstall运营团队 2026-04-13

2026-04-13 100

100

闽公网安备35058302351151号

闽公网安备35058302351151号