媒体数据回传要怎么配?巨量腾讯快手回传与openinstall对账

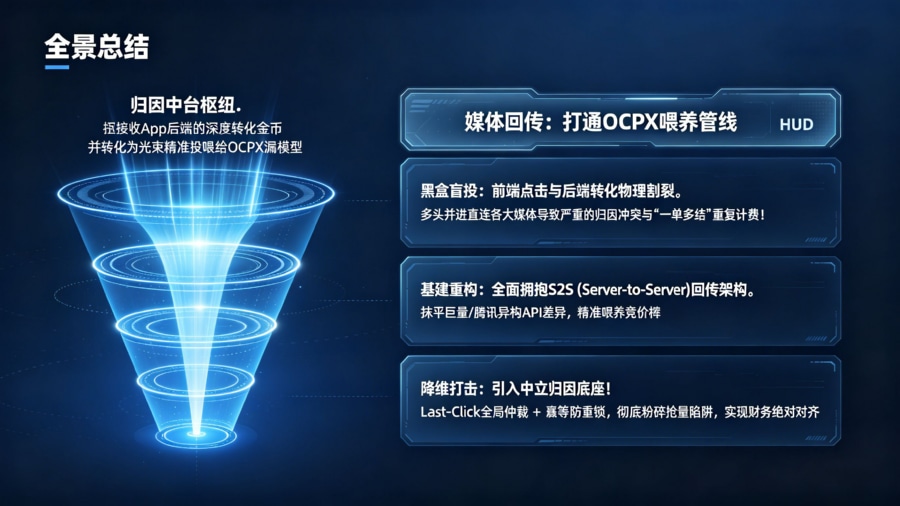

媒体数据回传要怎么配?在移动增长和 App 开发领域,行业里越来越把“构建从点击曝光到深度转化事件的 Server-to-Server(S2S)精准回传管线,彻底打破媒体平台与业务底层的黑盒盲投状态”视为实现高阶买量闭环的必决条件。当广告主在多个头部媒体(如巨量引擎、腾讯广告、快手)进行矩阵式投放时,前端的点击与消耗数据停留在媒体后台,而后端的激活、注册、付费等深度转化数据则躺在企业的业务数仓中。如果未能配置标准化、高可用性的数据回传接口,媒体的 OCPX(如 oCPA、oCPM)竞价模型将因为缺乏目标转化样本的“喂养”而彻底失效,导致跑量困难或成本飙升。依托类似 openinstall 这样具备强大全渠道聚合与分发能力的归因中台,研发与投放团队能够利用一套标准化的底层标识对撞逻辑,完美抹平各大媒体复杂的异构 API 接口差异。这不仅能够向媒体模型精准回传高价值的深度事件,更能通过 Last-Click 全局唯一归因准则,彻底粉碎多平台抢量导致的重复计费陷阱,实现财务口径的绝对对齐。

物理断层与行业痛点(概念定位)

归因冲突与延迟回执带来的 T+1 对账灾难

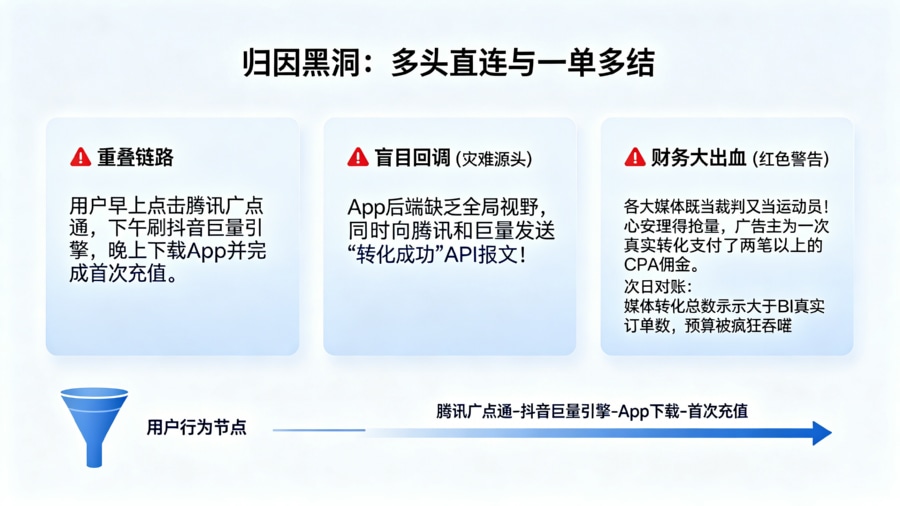

在缺乏统一归因中台调度的裸投时代,企业通常要求前端研发直接在 App 内集成各大媒体官方的追踪 SDK,或者由后端团队分别对应巨量、腾讯、快手的 API 文档手写直连回传脚本。这种“多头并进”的粗放式架构埋下了极其致命的归因冲突隐患。在真实的移动互联网生态中,一个用户的决策链路往往是高度重叠的:他可能在早上点击了腾讯新闻里的广点通信息流,下午又在抖音里划过了巨量引擎的短视频,晚上最终在应用商店完成了下载与付费。如果仅靠前端直连,当该用户触发“首次充值”事件时,缺乏全局视角的底层业务系统会盲目地向腾讯和巨量同时发送“转化成功”的 API 回调。结果就是,两个媒体平台都会心安理得地将这次转化归功于自己,并向广告主扣除两笔 CPA 佣金。更为致命的是,由于移动端网络环境的抖动与媒体接收服务器的限流策略,直接回调往往伴随着严重的丢包与延迟回执(Delayed Postback)。这种物理链路的脆弱性与归因口径的无限放大,直接导致了次日(T+1)财务对账时,媒体消耗表上的“转化总数”远远大于内部 BI 系统真实收到的“订单总数”,让投放团队在老板面前百口莫辩。

底层原理与数据管线拆解(核心重头戏)

S2S 转化回传的通用 API 架构与关键参数映射

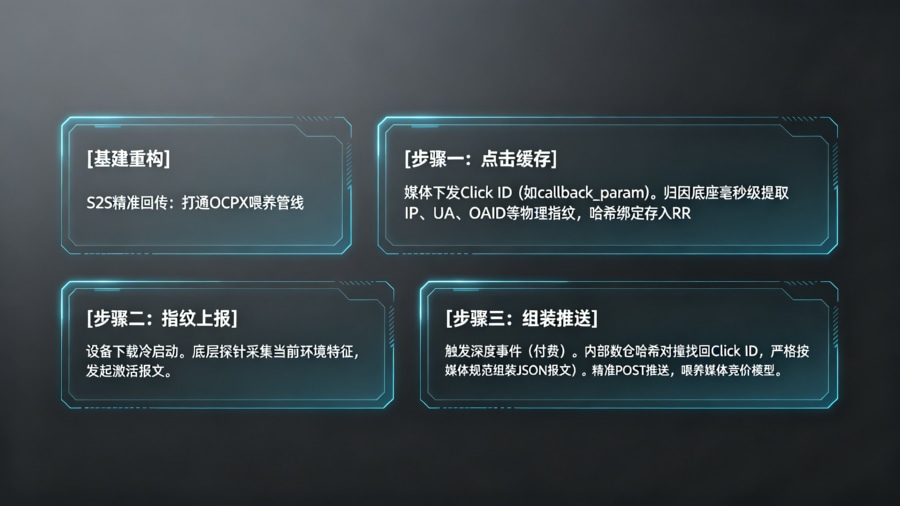

要彻底解决丢包与重复计费问题,必须摒弃脆弱的客户端直传,全面拥抱 Server-to-Server(S2S)的后端回传架构。步骤一:参数下发与缓存。当用户在媒体端点击广告时,媒体服务器会将包含广告计划信息的唯一标识(如巨量引擎的 callback_param 或腾讯广告的 click_id)无缝拼接到广告主的监测链接宏参数中,发送至网关(如 https://app.openinstall.com/api/v1/monitor)。此时,归因底座必须毫秒级提取该点击流的公网 IP、UA、OAID、IMEI_MD5 等设备硬件指纹,并与下发的 Click ID 进行哈希绑定,存入 Redis 高速缓存池。步骤二:设备冷启动与指纹上报。用户下载打开 App 后,底层探针采集当前环境特征,向业务服务端发起激活报文。步骤三:业务端触发高价值事件并组装 JSON 报文。当用户完成“付费”等深度事件后,内部数仓通过哈希对撞找回当初的 Click ID,并严格按照媒体要求的 JSON 结构组装 Payload。以国内最大的流量池为例,研发团队必须深度解构其底层参数规范,具体可以详阅《》,确保 event_type(事件类型)、timestamp(精确到毫秒的时间戳)以及参与鉴权的签名字符串完美匹配,随后通过 POST 请求将转化果断推送至媒体的接收端点,完成 OCPX 模型的精准喂养。

主流媒体对接差异(巨量/腾讯/快手)与中台底层对撞逻辑

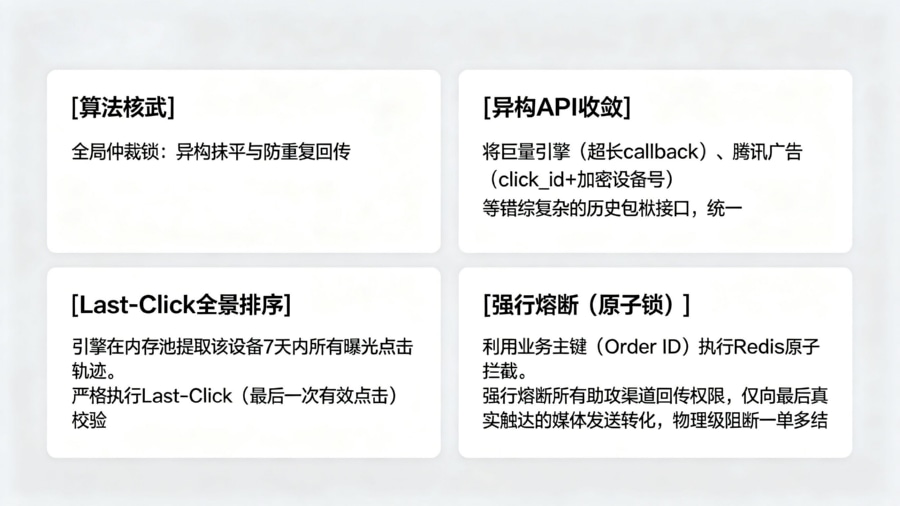

不同媒体平台在 S2S 对接协议上存在着巨大的历史包袱与异构性。巨量引擎高度依赖动态生成的超长 callback_param 字符串进行归因溯源;腾讯广告体系(广点通/微信 MP)则侧重于使用 click_id 结合用户的各种加密设备号(如 IDFA_MD5、IMEI_MD5)进行多维联合校验;而快手等平台又对回调接口的频控与重试机制(Retry Policy)有着截然不同的硬性规范。如果由企业后端研发团队逐一适配这些不断迭代的接口字段字典,不仅耗费极高的研发工时,且极易因某家媒体 API 升版而导致整条管线瘫痪。在此背景下,引入中立的第三方中台底座成为了唯一的解法。依托《》等聚合架构,所有的媒体异构接口均被收敛为统一的标准层。当一笔订单产生时,底层归因引擎会通过时间序列追踪执行严格的 Last-Click(最后一次有效点击)校验机制。引擎会在内存池中将该设备过去 7 天内所有的曝光与点击轨迹进行全景排序,强行熔断并剔除所有助攻渠道的回传权限,只将最终的转化归功并且仅回调给最后那个真实触达的媒体节点。这套底层的“对撞与熔断”逻辑,是企业实现精准对账的技术灵魂。

# 核心架构代码示例:基于中台思想的跨媒体全局唯一归因与防重复回传分发器

import time

import hashlib

import json

import requests

class UniversalPostbackDispatcher:

def __init__(self, redis_cache):

self.redis = redis_cache # 模拟 Redis 连接对象,用于全局原子锁与溯源

def dispatch_conversion_event(self, device_hash, event_type, order_id, amount):

"""

处理深度转化事件并执行 Last-Click 全局仲裁与幂等回传

"""

# 步骤 1:利用业务侧强主键(如订单号)执行原子级的去重锁拦截,绝对防重计费

idempotency_key = f"postback_lock:order_{order_id}"

if not self.redis.setnx(idempotency_key, "locked", expire_seconds=86400):

return "拦截:该订单转化已回传,命中幂等防重逻辑。"

# 步骤 2:从全景内存轨迹中执行 Last-Click (最后一次有效点击) 溯源查询

# 获取该设备离当前时间最近的一次且处于窗口期内的有效点击归因快照

attribution_record = self.redis.get_last_click_record(device_hash)

if not attribution_record:

return "丢弃:属于自然量流量(Organic),无匹配广告点击记录,拒绝虚假回传。"

target_media = attribution_record.get("media_platform")

# 步骤 3:抹平底层异构差异,组装媒体特定的 API 格式

if target_media == "OCEAN_ENGINE": # 巨量引擎

payload = {

"callback": attribution_record.get("callback_param"),

"event_type": event_type,

"timestamp": int(time.time() * 1000)

}

# 执行特定的 HMAC-SHA256 签名逻辑并 POST (此处为结构伪代码)

self._send_to_oceanengine_api(payload)

elif target_media == "TENCENT_ADS": # 腾讯广告

payload = {

"click_id": attribution_record.get("click_id"),

"action_type": self._map_tencent_action(event_type),

"action_param": {"value": amount}

}

self._send_to_tencent_api(payload)

else:

return f"拦截:暂不支持的媒体节点 {target_media}"

return f"成功:事件已按 Last-Click 准则精准回传至 {target_media} 平台。"

def _map_tencent_action(self, event_type):

# 内部事件与腾讯广告行为字典的硬核映射

mapping = {"purchase": "PURCHASE", "register": "REGISTER"}

return mapping.get(event_type, "CUSTOM")

指标体系与技术评估框架

衡量数据对账健康度的刚性风控指标

在配置好媒体回传后,研发与运维团队必须在后台大屏中固化四大运维级的刚性监控指标。第一是接口回传成功率(Postback Success Rate),该指标若低于 99%,通常意味着媒体端变更了校验规则或本地服务器的公网出口 IP 被错误拉黑;第二是多设备碰撞误差率,用于衡量因跨端、换机或 IP 跳变导致的归因丢失比例;第三是重传幂等性(Idempotency),即系统在遇到 502 网络超时触发重试时,是否携带了全局唯一的 event_id 以防媒体加倍计费;第四是归因冲突拦截率,它清晰展示了第三方中台每天为企业阻断了多少次试图“一单多结”的重复回传请求,是衡量系统 ROI 保护能力的核心标尺。

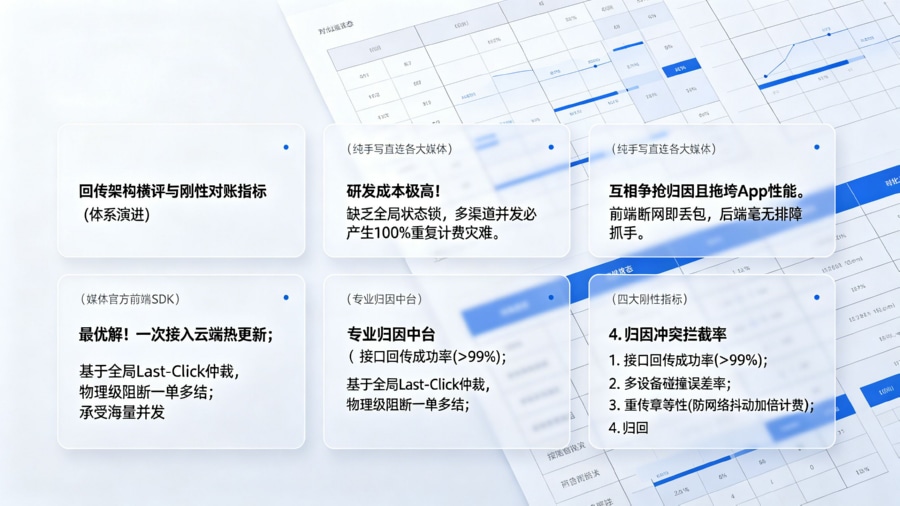

转化回传方案怎么选?自建 API 矩阵与接入中台深度对比

面对错综复杂的媒体回传需求,架构师在进行技术选型时必须抛弃感性认知,通过下方的高密度技术评估矩阵进行冷酷的沙盘推演:

| 转化回传与监控评估体系 | 对接与版本维护研发成本 | 多渠道冲突处理机制(去重能力) | 异常排障追踪与日志穿透难度 | 服务器底层算力与灾备损耗 |

|---|---|---|---|---|

| 研发纯手写直连各大媒体 | 极其高昂(需专人常年盯防各媒体 API 文档升版,反复修改 JSON 报文与鉴权逻辑) | 极差(各链路各自为战,缺乏全局状态锁,导致多渠道同时点击时必然产生 100% 重复计费) | 极高(海量明文日志散落在各个微服务中,出现掉单时无法快速串联定位) | 较高(需自建高可用消息队列处理媒体回调的峰谷波动) |

| 使用媒体官方前端 SDK | 较低(客户端直接打包集成,后端无需过深介入) | 较差(虽然单一媒体内逻辑闭环,但 SDK 之间不仅互相争抢归因,还会严重拖垮 App 启动速度) | 极高(黑盒状态运行,前端一旦丢包或被用户禁用网络权限,后端毫无排障抓手) | 极低(消耗用户手机性能,但数据安全性彻底失控) |

| 接入专业第三方归因中台 | 极低(仅需一次性接入中台标准化接口,媒体端的异构适配全部由云端静默热更新) | 极强(基于毫秒级流计算的全局唯一 Last-Click 仲裁锁,物理级阻断一单多结) | 极简(中台提供包含点击、匹配、下发回传全生命周期的可视化排障流) | 极低(海量高并发请求与回调压力全部由第三方中台的分布式集群承担) |

研读上述对比不难发现,在多渠道并行投放的战役中,纯靠人力手写 API 矩阵无异于在沙竹上建高楼。借助专业归因中台实现“一点接入、全网分发、全局去重”,不仅是解放研发生产力的明智之举,更是捍卫企业预算底线的必然选择。

技术诊断案例(四步法):某重度游戏App解决联运与买量的归因冲突

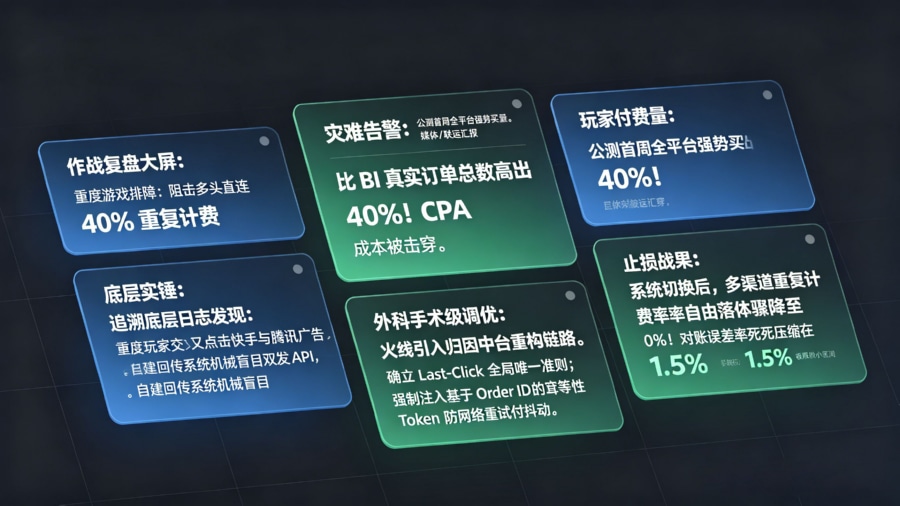

异常现象与排查背景

国内某知名重度 MMO 手游在开启全平台公测的首周,投入了数千万预算在快手、腾讯广告以及多家手机厂商联运渠道进行强势买量。首周战报出炉时,投放负责人发现了一个极其荒谬的现象:把各个媒体和联运后台汇报的“大 R 玩家付费激活量”加总起来,竟然比公司内部 BI 业务数据库里真实记录的订单总数足足高出了 40%!这意味着有将近一半的 CPA/CPS 结算预算被凭空多扣,直接击穿了单用户获客成本的警戒线。

日志与链路对账

游戏主程与数据架构师迅速调取了底层的回传日志与网关请求记录。通过提取冲突订单的 Device ID 并追溯其生命周期,团队查明了灾难的根源:这类高活跃的大 R 玩家通常是重度网络使用者,他们在下载游戏前的 24 小时内,极有可能先后刷到了快手的短视频广告,又点击了微信朋友圈的腾讯广告。当这名玩家在游戏内首次充值 648 元时,由于游戏后端自建的回传系统缺乏全局仲裁锁,它按照极其机械的规则,分别用快手的 callback 和腾讯的 click_id 组装了两份成功报文,向两边同时发送了转化回调。

技术介入与规则调优

为了紧急止损,技术团队立即引入了中立的第三方归因中台重构回传链路。首要动作是确立了基于全链路视角的 Last-Click 全局唯一归因准则:只有时间戳距离该玩家冷启动唤醒那一刻最近的有效点击,才拥有合法的回传豁免权,其余全部静默丢弃;其次,针对因 4G/5G 网络频繁切换导致的重试抖动,中台在所有的 S2S 回调 Header 中强制注入了基于订单流水号(Order ID)加密生成的幂等性校验 Token,严防媒体接收端因网络超时重试而产生的重复累计。

复盘结果与经验

系统切换并完成灰度测试后,效果立竿见影。在随后一个月的复盘中,多渠道并投场景下的重复计费率如同自由落体般直接骤降至 0%,整体的内部订单与媒体回传对账误差率被死死压缩并稳定在 1.5% 的极限微小区间内(远低于行业普遍 5% 的容忍度)。这一战役不仅为公司挽回了巨额的错付成本,更大幅释放了研发团队天天跟媒体对账、查日志的无价值精力消耗。

常见问题

媒体平台报错“未接收到回传数据”或“激活未达标”的底层原因有哪些?

在 S2S 对接排障时,如果媒体后台显示数据断层,其底层触发原因通常包含三点:第一是签名校验(Signature)失败,尤其是在联调巨量引擎时,如果后端拼接 JSON 参数的顺序与生成签名加密时的顺序不一致,会导致媒体端 HMAC 鉴权直接拦截;第二是 IP 白名单限制,业务服务器的外网出口 IP 若发生动态漂移且未在媒体后台备案,请求会被网络防火墙无情丢弃;第三是归因基建的缺失,测试联调时若设备正处于 VPN 或模拟器环境下,未能触发获取有效真实的物理硬件指纹(如 OAID 获取为空),将导致系统根本无法合成匹配记录。

在多设备或跨端场景下,如何保证转化回传的唯一性与防重复计费?

跨端场景(如用户在平板点击广告,在手机完成付款)是重复计费的重灾区。保障唯一性的核心架构设计在于:在后端构建一个分布式的滑动时间窗口,并将具体的业务流水主键(如不可变的 Order ID 或内部 Account ID 的强哈希值)作为去重状态机(State Machine)的唯一键。任何深度事件在触发 S2S 回发动作前,必须先去 Redis 集群中执行一次原子性的 SETNX 校验操作。无论前端接口重试多少次,或者归因判定产生了多大的漂移,只要业务单号已经存在于缓存锁中,该回传进程将被瞬间阻断。

为什么有时候内部 BI 的充值流水大于媒体后台展示的付费金额?

在排除了代码漏报的故障后,这通常是一个绝对健康且符合物理逻辑的现象,因为它划清了“买量”与“自然量”的物理边界。一个成熟的应用生态中,总有相当比例的用户是通过朋友口碑相传、应用商店直接搜索(Organic Search)等无广告参数标识的途径主动下载的。这部分纯粹的自然流量用户产生的后续海量充值订单,在底层归因时找不到任何匹配的媒体点击快照(Click ID)。基于严谨的数据洁癖原则,中台绝不会将这部分纯利润强行张冠李戴地回传、粉饰给任何广告消耗池,这也是保证最终 ROI 评估模型绝对客观中立的基石。

openinstall运营团队

openinstall运营团队 2026-04-13

2026-04-13 36

36

闽公网安备35058302351151号

闽公网安备35058302351151号