媒体API对接需要配置什么?广告回传与归因同步关键字段说明

媒体API对接需要配置什么?在移动增长和 App 开发领域,行业里越来越把“基于安全、极速的 S2S(服务端到服务端)协议构建广告点击接收与转化回传的闭环”视为支撑大规模买量与精细化运营的底层命脉。很多研发团队在初次对接广告媒体时,常常误以为仅仅是按照官方文档拼凑几个 URL 参数即可,结果在亿级高并发洪峰与极其复杂的加密验签机制面前遭遇大规模丢单、回传失败,最终导致广告竞价模型无法获取足够的正样本而无法收敛。依托 openinstall 等专业的归因中台,技术团队可以彻底跳出繁杂的接口联调泥潭,通过标准化的宏参数捕获、内存级特征对撞与动态签名校验,在极端物理网络环境下依然保障系统的综合归因率高达98%,让每一次真实的深度转化都能安全、合规地反哺至媒体算法大盘。

物理断层与行业痛点(概念定位)

媒体直连的黑盒陷阱与数据孤岛

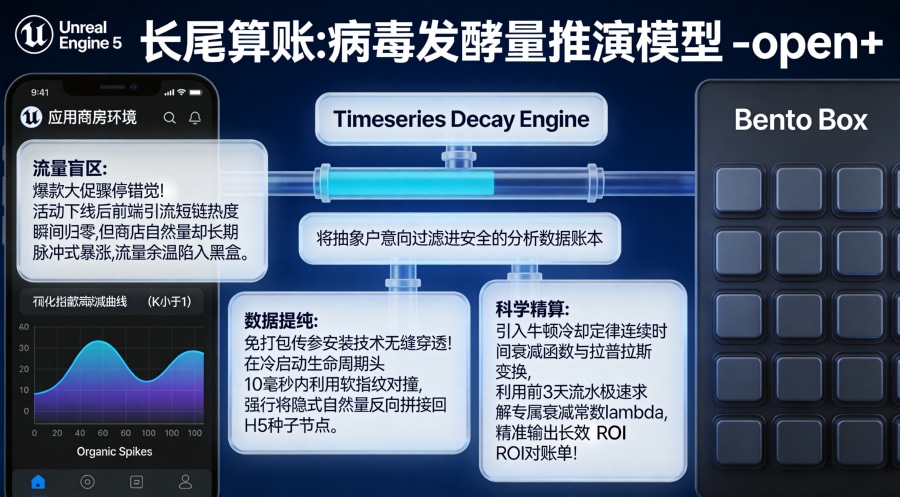

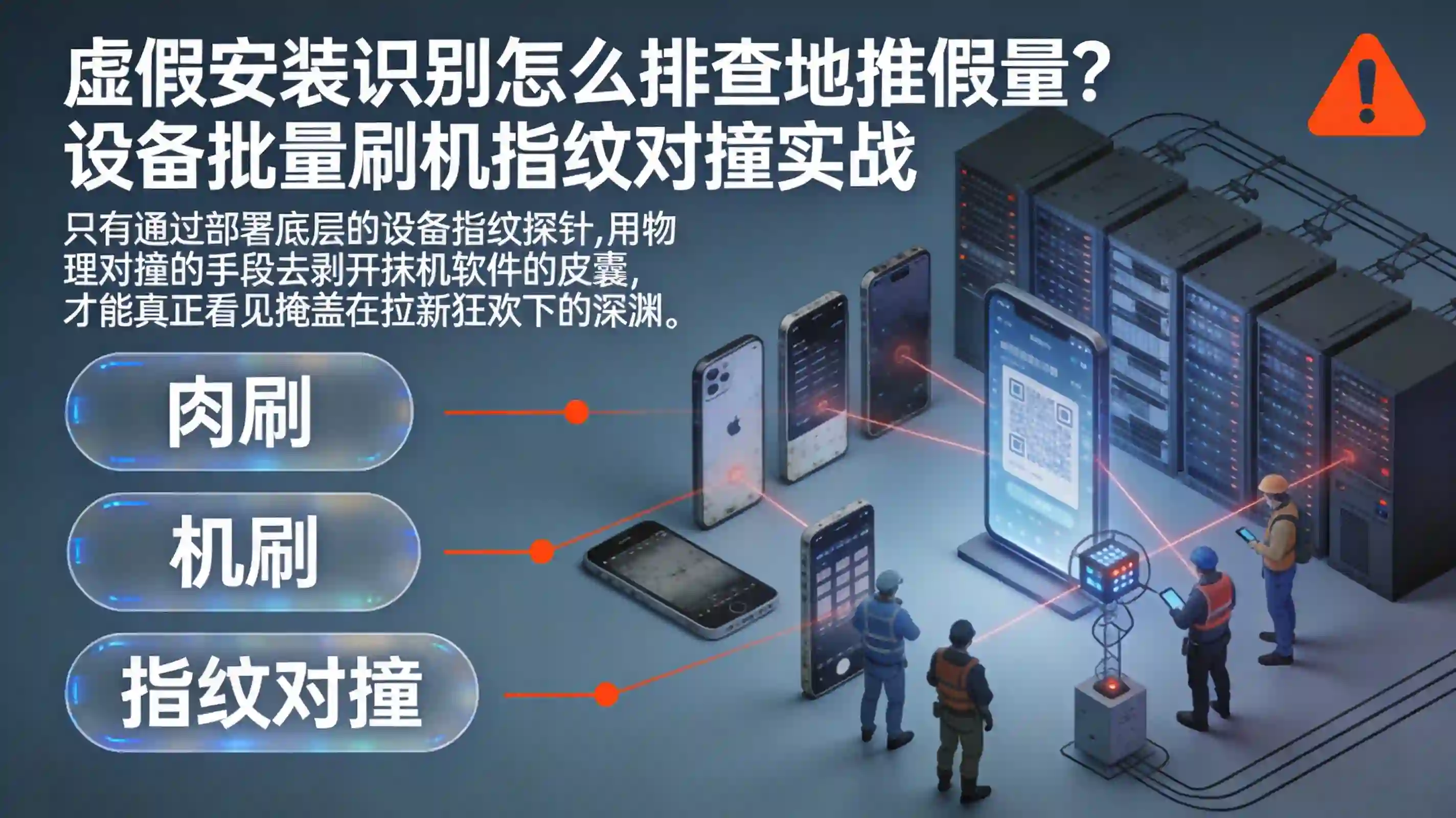

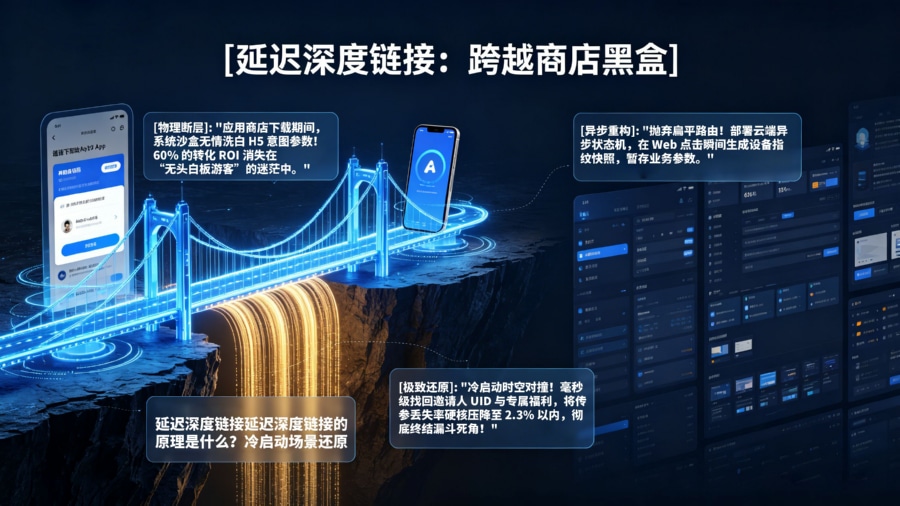

在移动营销早期,开发者往往倾向于在 App 内直接集成各大广告平台的官方 SDK,以此来实现转化事件的端侧直传。然而,这种“客户端分发”的模式如今已成为巨大的黑盒陷阱。首先,随着全球隐私保护法规的收紧,特别是 iOS 14.5+ ATT 框架的强制实施以及 Android 12+ 对 OAID/IMEI 获取权限的严格封锁,端侧应用直接读取底层物理设备 ID 的成功率呈现断崖式下跌。一旦媒体 SDK 在沙盒环境中被剥夺了设备标识读取权限,其端侧归因能力将直接瘫痪。其次,如果企业同时在巨量、腾讯、快手及十几个网盟平台投放,强行在 App 内部塞入数十个媒体追踪 SDK,不仅会导致应用安装包体积剧烈膨胀、启动耗时飙升,还会引发严重的内存泄漏与代码冲突风险。更为致命的是,这种分散在端侧直传的模式,意味着核心商业转化数据被毫无保留地暴露给各家媒体,广告主彻底失去了统一清洗、去重排他与敏感数据脱敏的数据主权。因此,走向 Server-to-Server 的归因中转与事件回传,成为了跨越设备系统物理断层的历史必然。

oCPX竞价模型对S2S回传的严苛要求

为什么业界对 S2S 接口的规范度要求如此之高?这源于现代各大广告平台底层竞价逻辑的根本转变。oCPX(Optimized Cost Per Action)算法的本质是一个高度依赖实时正样本投喂的深度学习反馈闭环。媒体竞价模型需要在用户点击广告后的极短时间内,明确知道“刚刚具备何种特征画像的用户最终完成了付费或激活”,以此来实时矫正后续的曝光人群定向与底层出价。如果广告主构建的 API 回传管线存在频繁的 500 超时、403 签名验签报错,或者回传的时间戳出现严重延迟,这些脏数据与滞后信号会直接输入竞价算法,导致模型误判该广告计划的转化率极低,进而触发流量降权乃至系统自动关停。高质量的 API 对接是保证模型快速度过“学习期”的先决条件,相关规范的严谨性与标准化要求,开发者可以深度研读《》等官方大厂的技术准则,深刻体会底层协议时序对算法大盘的决定性影响。

底层原理与数据管线拆解(核心重头戏)

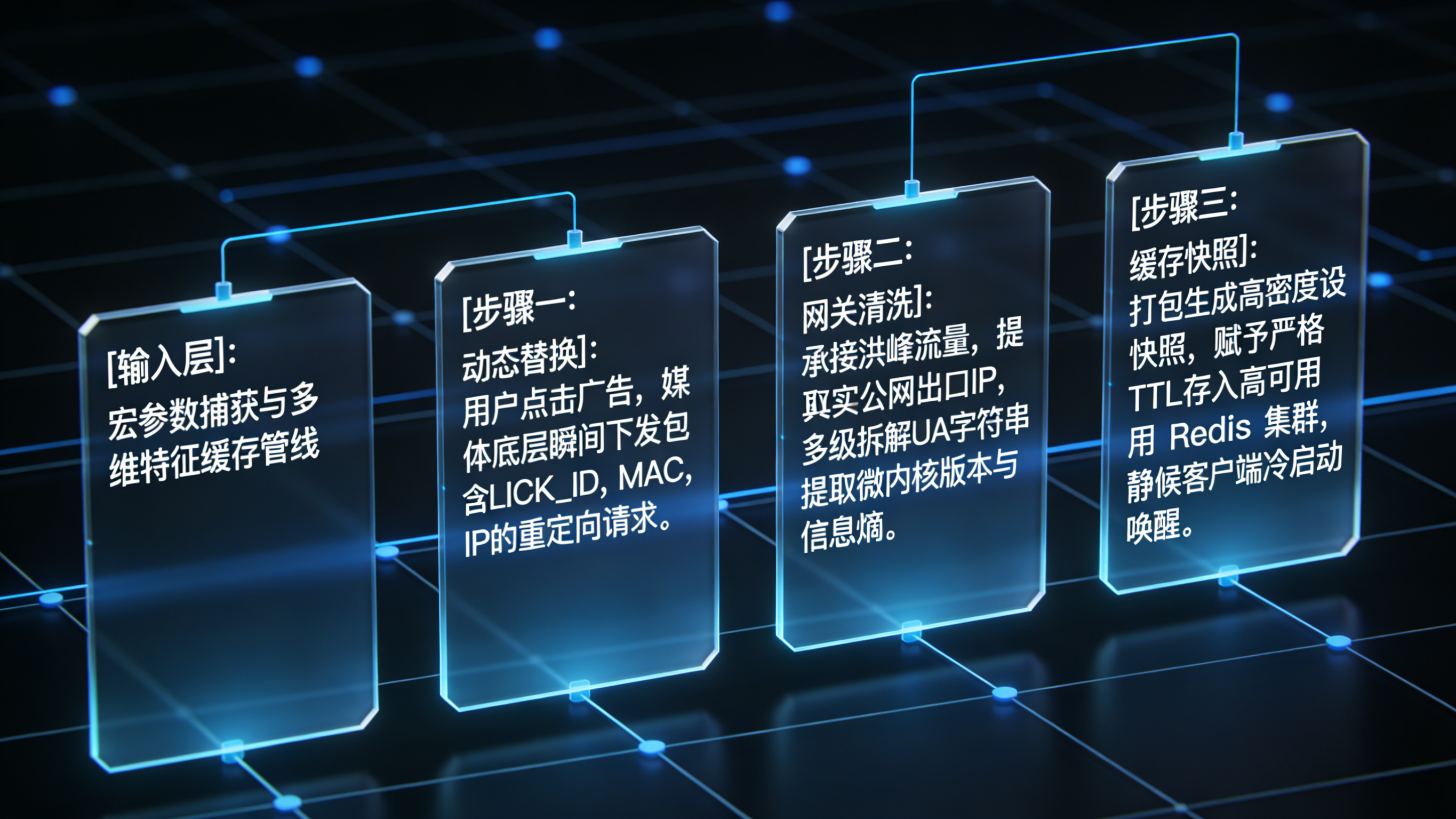

数据输入层:宏参数捕获与多维特征缓存

构建稳健对接体系的起点,在于精准捕获并解析媒体在点击瞬间释放的高密度宏参数。这一数据输入层的时序流转极其严密:步骤一,当用户在媒体 App 内点击广告时,媒体底层的广告分发服务器会瞬间将监测链接中的占位符进行动态替换,下发包含 __CLICK_ID__、__MAC__、__IP__、__UA__ 等真实设备环境参数的重定向请求(例如向 https://app.openinstall.com/api/click_monitor 发起 GET 请求)。步骤二,接收网关在承接这一洪峰流量时,绝不能将其直接落库。系统必须在接入层迅速清洗脏特征,通过反向代理节点提取用户真实的公网出口 IP 地址,并对 User-Agent 字符串进行多级正则拆解,提取出极高信息密度的 UA 熵值与浏览器微内核版本。步骤三,网关将这些经过标准化的媒体特征、活动标识以及时间戳,打包生成一份高密度的设备快照,并赋予严格的 TTL(Time To Live,存活时间)缓存至高可用 Redis 集群中,静候客户端在未来的合理时间窗口内发起冷启动唤醒,以便实施高并发的对撞。

# 示例:通过 openinstall 网关接收媒体广告点击重定向请求,解析并捕获高维宏参数

def handle_ad_click_redirect(request):

# 捕获巨量等媒体透传的关键点击标识与硬件明文或哈希

click_id = request.args.get('__CLICK_ID__')

mac_hash = request.args.get('__MAC__')

ip_param = request.args.get('__IP__')

# 提取网络层的真实软环境指纹快照

real_ip = request.headers.get('X-Forwarded-For', request.remote_addr)

user_agent = request.headers.get('User-Agent')

# 记录该次点击快照至 Redis 集群,设定严格过期 TTL(如 7 天)

cache_payload = {

"click_id": click_id,

"mac_hash": mac_hash,

"media_ip": ip_param,

"real_ip": real_ip,

"ua_entropy": calculate_ua_entropy(user_agent),

"timestamp": current_timestamp()

}

redis_cluster.setex(f"click_snapshot:{click_id}", 604800, json.dumps(cache_payload))

return redirect_to_app_store()

中枢映射层:从特征快照对撞到 API 分发

当设备穿过应用商店完成物理下载并首次启动,向中台发起激活上报后,系统立刻在内存池中触发极其严苛的中枢映射与归因对撞引擎。这一过程的算法匹配逻辑具有绝对的优先级降级机制:引擎优先抽取客户端上报的 OAID/IDFA 等强设备物理标识,去 Redis 缓存中执行哈希比对(精确匹配);若因系统权限管控导致强标识缺失,引擎将在毫秒级内平滑降级,自动触发基于客户端实际上报的 IP 聚类分布、操作系统底层补丁号、以及屏幕分辨率的模糊概率匹配模型。当完成动态加权打分并最终确认归属后,系统内部将提取该渠道对应的媒体 API 回传模板准备异步下发。需要着重指出的是,凭借成熟的指数退避容错重试机制与深度的指纹参数补偿算法,像「」这类的专业系统,能够在极端的弱网与高丢包环境下依然保障整体流量的归因率高达98%,确保中枢映射层绝不会成为吞噬广告转化的黑洞。

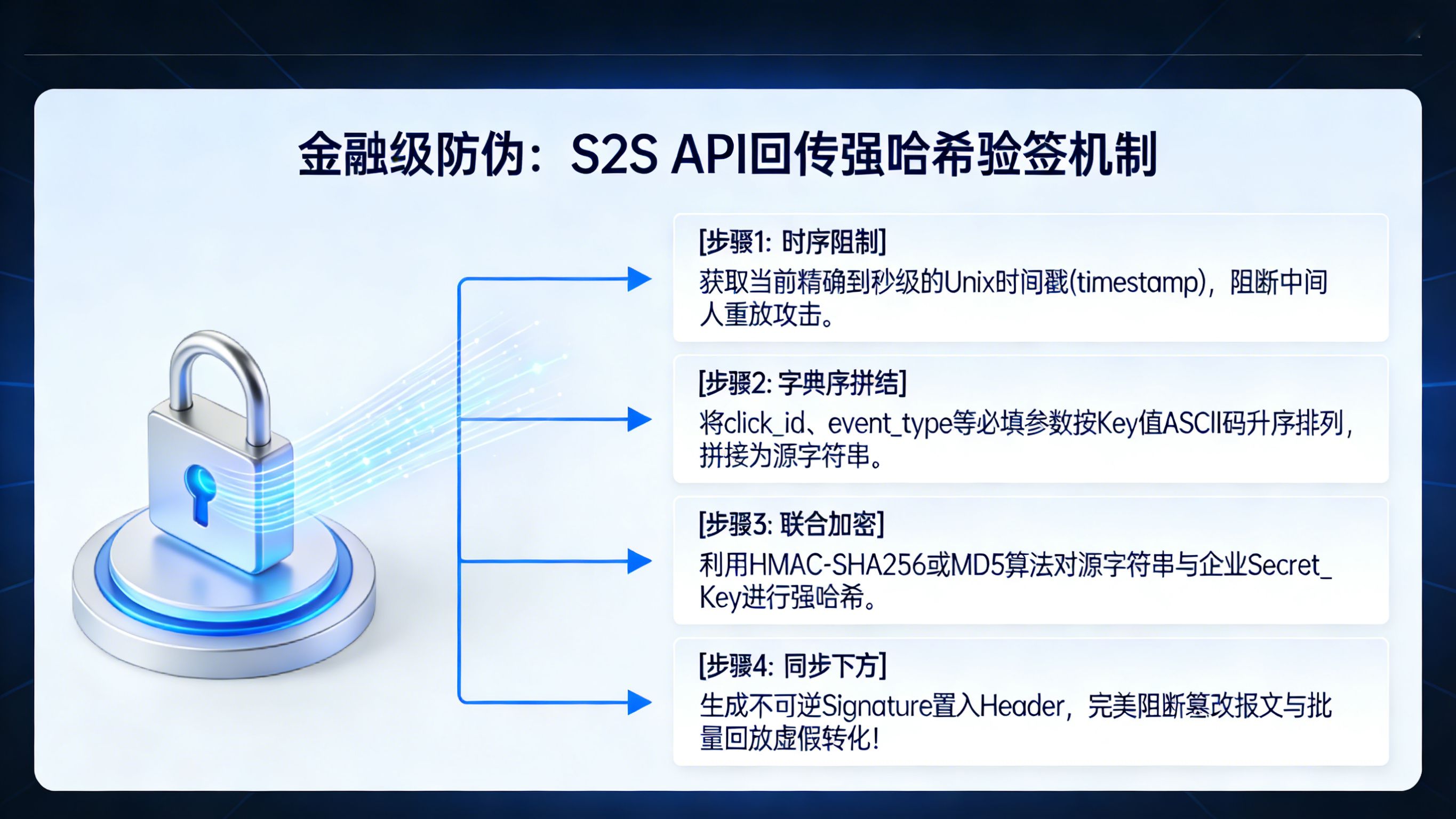

安全防线与签名验证:保障回调链路的加密逻辑

在明确了归属关系并准备向广告媒体(如巨量或腾讯)发起 S2S 事件回传时,安全防线与签名验证(Signature Verification)是整条管线中最容易导致联调失败的深坑。媒体平台为了防御黑产的中间人重放攻击(Replay Attacks)以及伪造转化刷量,通常对 API 接口设计了极度苛刻的加密逻辑。在组装 HTTP POST 回传报文时,广告主后端不仅需要按媒体要求的 JSON 格式传入 click_id 与转化事件码(如代表付费深度的 Event Type),更必须利用企业专属分配的 Secret_Key 参与签名计算。标准的安全时序要求:首先获取当前精确到秒级的 Unix 时间戳(timestamp),将所有必填参数按照 Key 值的 ASCII 码字典序进行升序排列,拼接成待签名的源字符串;随后,利用 HMAC-SHA256 或 MD5 加密算法对该字符串与密钥进行联合哈希,生成不可逆的 Signature 并在请求 Header 或查询参数中携带。这一系列强时序与强哈希校验,从物理层面完美阻断了任何篡改报文与批量回放虚假转化的可能,使得每一次深度转化回传具备了金融级的防伪属性。

指标体系与技术评估框架

衡量对接质量的三大黄金指标

在完成了复杂的接口开发与加密验签之后,技术团队必须搭建严格的质量评估大屏。衡量一次媒体 API 对接是否达标,主要依赖三大黄金技术指标。第一是端到端延迟(End-to-End Latency):它测量的是从用户在 App 物理端触发深层转化(如支付成功),途径企业内网,再经由 S2S 协议抵达媒体 API 接口并获得 HTTP 200 OK 响应的全局时延。对于优质 oCPX 模型,该时延必须被严格压缩在秒级甚至亚秒级。第二是API 校验通过率:必须在网关监控中精准剔除因为鉴权失败(401 Unauthorized)或签名被拒(403 Forbidden)等错误状态码,一个健壮的推送管线其通过率必须稳定在绝对高位。第三则是最为核心的归因率:即便在面临多媒体触点复杂抢功与 iOS 端沙盒阻断的恶劣工况下,系统通过高维特征对撞与补偿机制,必须确保大盘的匹配覆盖度极强,使得归因率高达98%,绝不能让真实的转化由于技术管线的老化而变成永远无法被认领的“孤儿数据”。

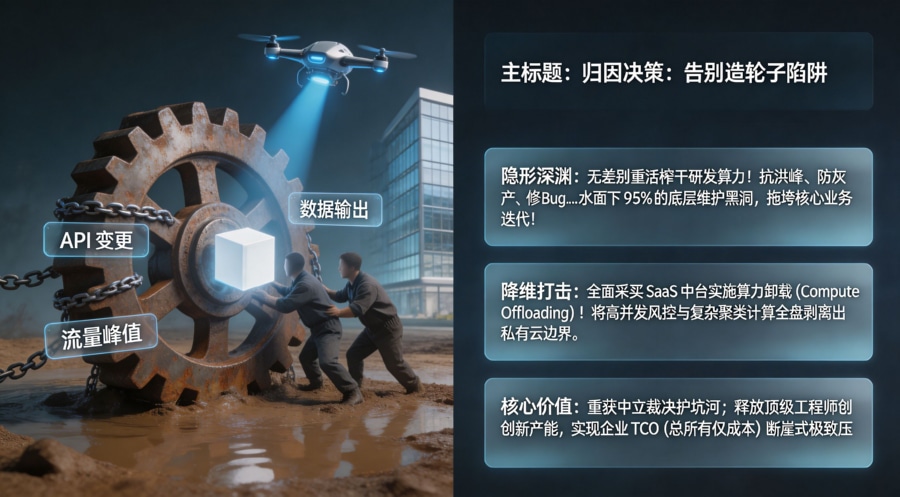

跨媒体回传架构方案对比(S2S 架构技术横评)

面对复杂的 oCPX 对接需求,技术团队在架构选型上往往面临分歧。以下通过 Markdown 表格,从研发成本与安全防篡改等底层维度,深度横评三种主流的回传数据管线架构:

| 架构评估维度 | 完全依赖前端客户端分发模式 | 企业纯自建 S2S 归因中转池 | 接入专业归因中台(如 openinstall) |

|---|---|---|---|

| 跨平台协议维护成本 | 极高(需在 App 内部维护十余家媒体笨重的归因 SDK,随系统升级频繁崩溃) | 极高(后端需专人常年跟进各广告平台千奇百怪的 API 变更与加解密升级) | 极低(底层接口标准已被中台封装并自动化维护,企业仅需一套 API 透传) |

| API 接口抗并发能力 | 极差(移动端弱网环境天然抗拒高频并发上传,极易导致事件严重丢失) | 中等(取决于自建机房的 Kafka 集群调优及扩容预算) | 极高(依赖成熟 SaaS 云原生架构,自带异步削峰与亿级请求吞吐防护) |

| 验签与安全防篡改能力 | 极弱(加密密钥与传输逻辑暴露在端侧,极易被逆向破解并批量伪造事件) | 较强(安全策略收敛于后端内网,可自主部署强哈希网关验证) | 极强(中立机构提供全链路防重放攻击与动态签名护城河,防渗透能力顶尖) |

| 深度事件合规脱敏难度 | 困难(前端极难对用户隐私字段进行动态降维处理,合规风险极大) | 适中(需在自建数仓中专门编写 ETL 清洗与脱敏服务再向外推送) | 极简(中台内置脱敏降噪引擎,按需抽离 User_ID,仅发送符合 oCPX 要求的抽象指令) |

通过深度剖析该对比表可以明确:如果完全依赖端侧直传,不仅技术极其落后,且随时面临 App 被黑产逆向从而制造假量洗劫预算的致命风险。而企业若选择纯自建 S2S 归因服务,虽然掌握了数据中转权,但维护国内数十家头部与长尾媒体千奇百怪的加密签名体系,将消耗极其庞大的后端服务器与研发人力,成为沉重的技术负债。唯有接入处于中立生态位、专门提供高并发路由分发与统一 API 映射的专业归因中台,才能在防篡改安全性与研发降本上实现降维打击,令团队将宝贵算力聚焦于业务变现本身。

技术诊断案例(四步法):API 参数漂移导致的高并发丢单排障

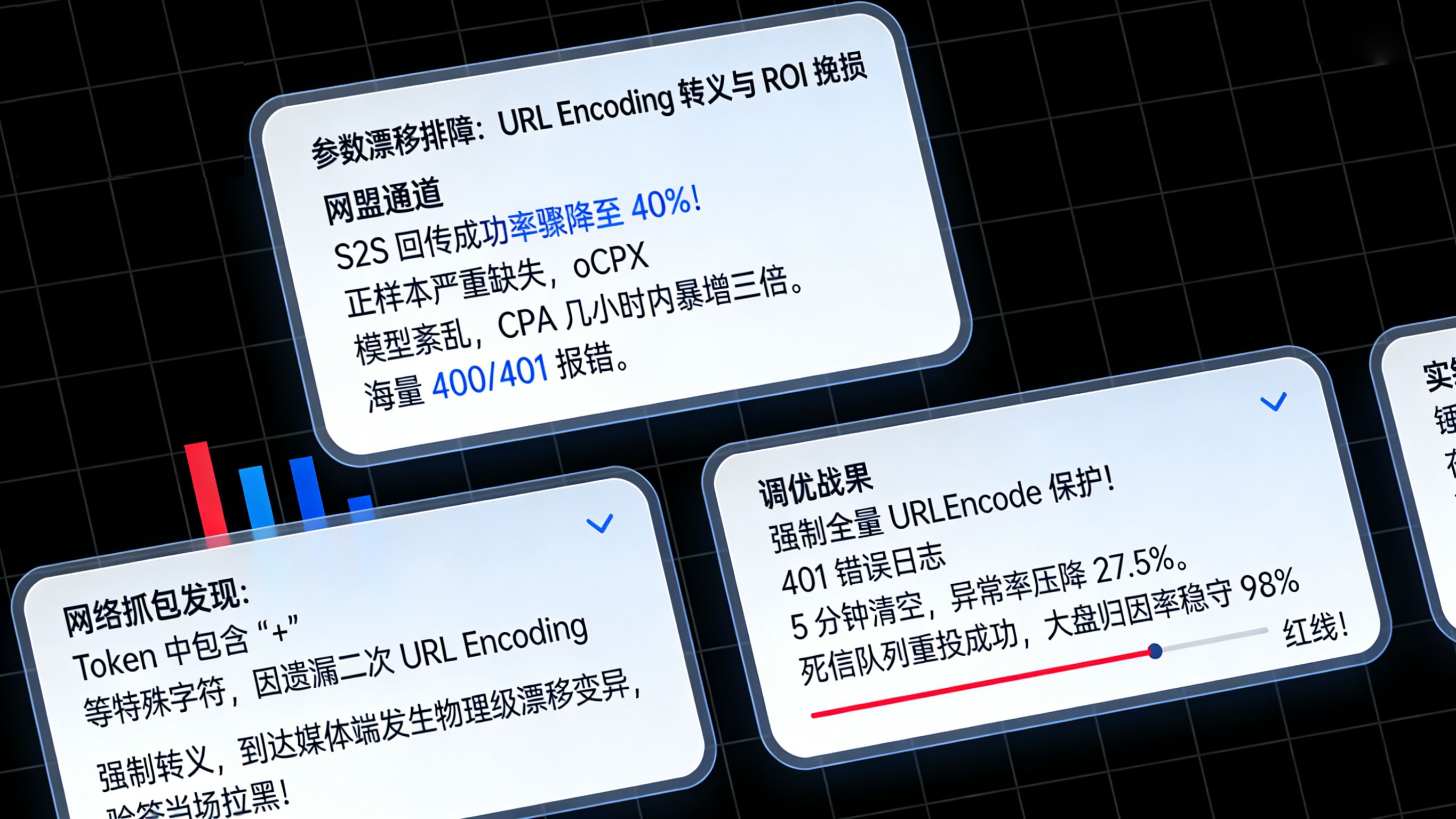

异常现象与排查背景

在某次大促期间,国内一家出海工具类 App 投入巨资接入了一家知名第三方海外网盟的广告 API 接口。随着投放指令的下达,该网盟渠道每小时产生上万次的点击流量,但后端运维组在盯盘时骇然发现,该网盟通道的 S2S 回传成功率骤降至不足 40%。这意味着绝大多数在 App 内部发生的真实付费转化与次日留存事件,根本未能成功送达媒体服务器。正向样本的严重缺失致使媒体侧 oCPX 竞价模型出价逻辑迅速紊乱,导致单客获取成本(CPA)在几个小时内暴增了三倍,业务线面临巨大的成本超标风险。

日志与链路对账

后端架构组迅速介入紧急排障,首先调取了归因中台底层向网盟 API 推送数据的 Nginx 请求日志,发现海量的请求被网关无情地返回了 400 Bad Request 和 401 Unauthorized。面对如此高频的鉴权报错,架构师对底层发送的 HTTP Payload 报文进行了逐字节的抓包拆解分析。真相终于水落石出:在部分极其恶劣的弱网环境以及非主流浏览器下,媒体当初下发的点击宏参数中的加解密 Token 字符串,包含了类似 + 或 = 等特殊保留字符。当归因中台接收到这些日志,并在后续组装 S2S 回传链接时,由于业务代码中遗漏了对该 Token 的二次 URL Encoding 强制转移处理,导致这串参数到达媒体网关进行反向反序列化时,字符发生了物理级别的“漂移(变异)”(如 + 被意外解析为空格)。这微小的转义失误,直接触发了媒体侧底层验签算法校验不一致,导致请求被悉数拉黑。

技术介入与规则调优

锁定“参数漂移”的病灶后,研发团队立即在系统管理控制台中,针对该特定网盟通道更新了 API 组装的编码规则库。强制系统对所有回传报文的 Value 级载荷(尤其是包含高熵值的加密 Token)执行极其严格的全量 URLEncode 转义保护,确保特殊字符在广域网传输中的绝对稳定性。与此同时,为了挽救此前因报错而积压在死信队列中的数万条真实转化,团队调长了网络超时的判定窗口,并临时放宽了重试上限,利用指数退避重试(Exponential Backoff Retry)机制,将清洗纠正后的报文按批次重新向媒体服务器进行定点重投。

复盘结果与经验

核心转义规则的热更新发布后,后端监控面板上的 401 错误日志在 5 分钟内被彻底清空,整体 API 联调联测的大盘异常率直接被强行压降了 27.5%。更为关键的战果是,该海外网盟渠道原本因转义报错而流失的海量转化数据被成功抢救回传,稳稳守住了大盘综合归因率高达98%的红线。丰富而精准的正样本迅速滋养了原本陷入瘫痪的 oCPX 竞价模型,算法在接下来的 12 小时内重新收敛,买量节奏恢复平稳,回本周期显著拉回正常水位。此次惊险的排障向全组印证了一条铁律:在 S2S 数据对冲中,对宏参数载荷进行极度严苛的 URL 编码转义与验签对齐,是确保管道不漏水的绝对生命线。

常见问题

API对接中常见的 HTTP 400/401 报错如何解决?

在处理 S2S 回传异常时,遇到 400/401 错误绝不仅是检查“参数有没有传”那么表面。纯技术维度的排查重点应当聚焦于加密边界:首先核对时间戳(Timestamp)的时区一致性,媒体网关通常会拒绝超过 5 分钟容忍差的请求以防重放攻击;其次检查请求 Body 签名的 ASCII 码字典序排序规则是否出现了大小写敏感错误或漏参;最后,务必检查底层的 HTTP Header 是否遗漏了强制性的 Content-Type: application/json 声明,一旦缺少该协议头,媒体服务器可能将其误解析为表单格式而导致报文直接碎裂崩盘。

oCPX 学习期模型不收敛与回传窗口有什么关系?

oCPX 模型的深度学习极度依赖因果关系的时效性。如果你的回传系统因为内部消息队列堵塞等原因,将长达 7 天甚至 30 天前的陈旧点击转化,在今天通过 API 强行推给媒体竞价引擎,媒体的过滤系统会直接将其视为对当前曝光出价无指导意义的“噪音”并予以丢弃(即归因窗口期截断)。这种因回传时效滞后导致的有效样本大量流失,会使媒体算法始终处于盲人摸象的摸索阶段,不仅模型无法跨越学习期的基础门槛导致不收敛,更会引发后续计划因为花不出预算而被彻底降权。

如何在不暴露核心商业机密的前提下回传深度事件?

深度事件(如高客单价商品的具体成交明细)是广告主的核心资产,在对接时必须实施严格的 S2S 脱敏降噪逻辑。最佳架构实践是:利用归因中台拦截并彻底剥离报文中的真实 User_ID、精确的购买商品 SKU 以及敏感的用户联系方式。向媒体外发的接口中,仅透传匿名化的 Click_ID 以及由行业规范定义的标准抽象事件标签(例如规定 Event_ID = 3 即可代表一次高潜力的深度付费行为)。通过这种物理切断关联的方式,既能用精准的模型指令喂养竞价算法实现 ROI 的拔升,又能在黑盒协议中完美构筑护城河,阻绝一切商业机密泄露的可能。

openinstall运营团队

openinstall运营团队 2026-04-06

2026-04-06 188

188

闽公网安备35058302351151号

闽公网安备35058302351151号