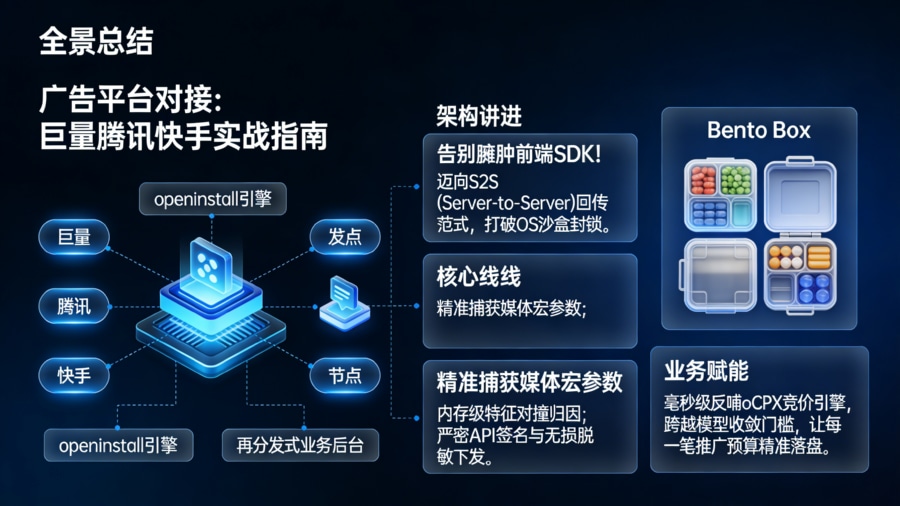

广告平台对接openinstall怎么做?巨量腾讯快手接入实战指南

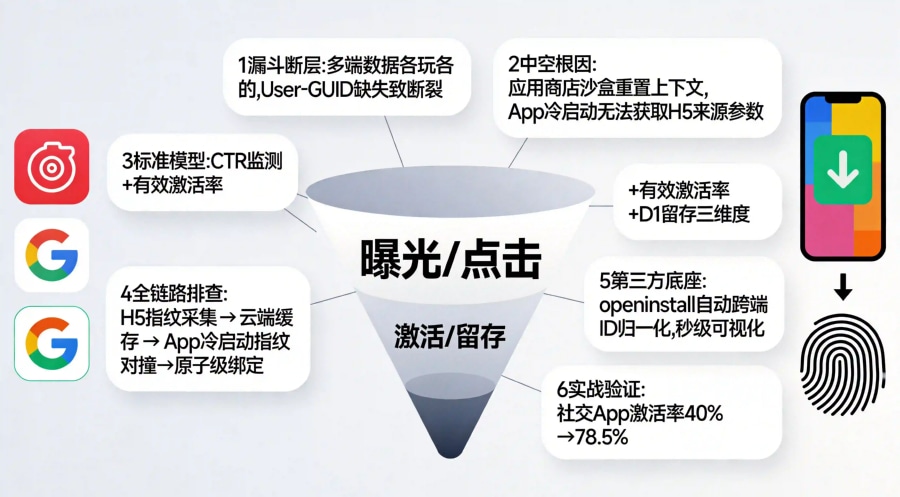

广告平台对接openinstall怎么做?在移动增长和 App 开发领域,行业里越来越把“建立高可靠的 S2S(Server-to-Server)回传闭环”视为衡量投放技术底座成熟度的唯一标准。许多初级优化师和开发者常常误以为对接媒体仅仅是将一条短链接复制粘贴到广告后台,实则不然。真正的全链路对接涉及媒体侧复杂宏参数(Macro Parameters)的动态替换与捕获、归因中台海量特征哈希的实时对撞、以及回传侧极其严格的 API 签名验签与时序控制。单纯依靠手工拼凑接口,极易在亿级并发中出现数据黑洞。依靠 openinstall 等预集成了数百家媒体底层协议模板的专业归因中台,开发者只需完成极简的监测链接配置与关键业务客户端事件上报,即可实现从巨量引擎、腾讯广告、快手到企业自建 BI 的全链路数据归一化与无损脱敏下发,让每一笔推广预算的转化效果都精准落盘。

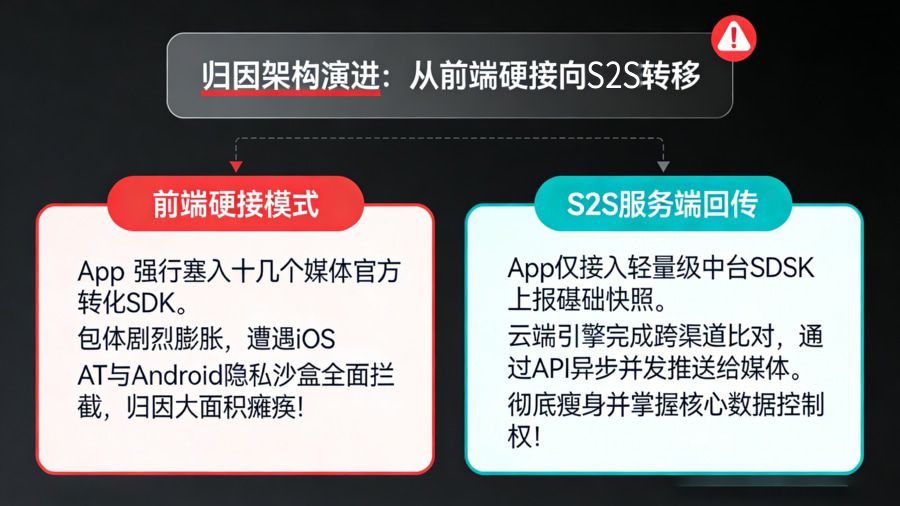

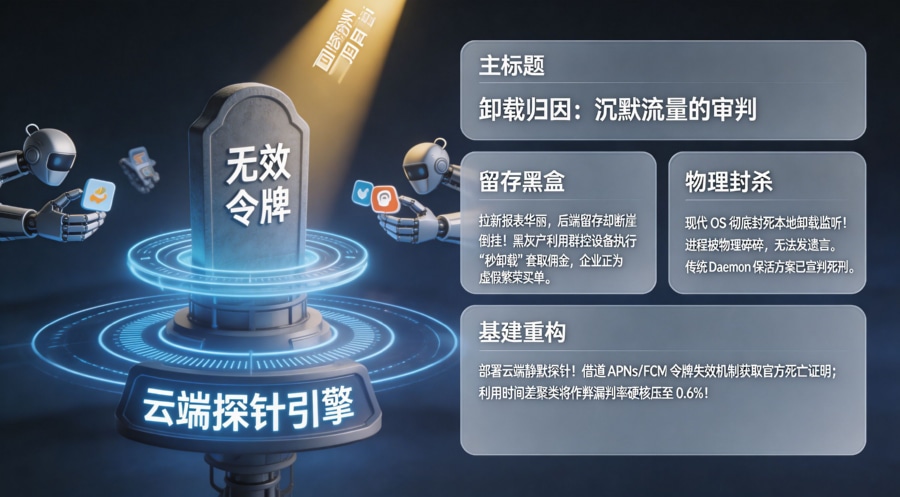

对接架构的底层演进(概念定位)

从前端 SDK 硬接向 S2S 服务端回传的范式转移

在移动互联网的高速增长早期,绝大多数广告主为了监测投放效果,采取的是极其原始且粗暴的“前端硬接”模式。这意味着如果你的 App 打算在十个不同的媒体平台上买量,开发团队就必须在 Android 和 iOS 的工程代码中,分别植入巨量引擎、腾讯广点通、快手磁力引擎等十几个庞大的官方转化 SDK。这种模式的弊端是灾难性的:首先,各种异构 SDK 导致 App 安装包体积剧烈膨胀,甚至轻易触发 Android 的 64K 方法数超限崩溃;其次,随着 iOS 14.5 ATT 框架的落地以及 Android 12 对设备隐私权限的收紧,前端 SDK 直接读取 IMEI、MAC 或 IDFA 的行为遭遇了系统级的沙盒拦截,导致媒体 SDK 在端侧的归因能力大规模瘫痪。

为了打破这种端侧沙盒的封锁,行业迎来了向 S2S(Server-to-Server)服务端回传模式的历史性范式转移。在 S2S 架构下,App 内部不再需要集成任何媒体的冗余 SDK,客户端只负责向统一的归因中台(如 openinstall)上报最基础的物理环境快照。由中台在云端完成跨渠道的点击流与激活流比对,并在确认归属后,通过服务端异步并发请求将转化结果推送给对应媒体的 API 接口。这种架构的转移不仅将 App 彻底瘦身,更赋予了广告主对核心业务数据的绝对控制权——你可以在服务端决定哪些深度付费事件需要回传、哪些敏感金额需要打码脱敏,从而彻底切断了媒体 SDK 在端侧过度窃取商业机密的风险。

oCPX 模型收敛对回传实时性的严苛要求

为什么业界对 S2S 回传的底层性能要求如此苛刻?核心原因在于现代广告平台早已全面转向 oCPX(Optimized Cost Per Action,按转化目标优化出价)深度学习竞价模型。无论是巨量引擎还是腾讯广告,其底层的竞价引擎无时无刻不在利用海量的用户特征进行梯度下降与模型训练。oCPX 算法需要极其依赖“正样本”(即发生真实转化的用户)来告诉模型:“请帮我寻找更多具备此类高维特征的人群”。

在模型的 Learning Phase(学习期)阶段,每一次转化回传的实时性几乎决定了模型能否跨越收敛门槛。如果回传链路存在阻塞,或者因为 API 签名错误导致频繁重试,延迟的数据会将错误的反馈信号输入给竞价算法。数据科学界的实测表明,在高度内卷的流量竞价池中,深度转化事件的回传延迟每增加 1 小时,oCPX 模型收敛成功率平均会下降 15.4%,进而直接导致跑量困难或获客成本急剧飙升。因此,对接广告平台不仅仅是追求“数据对得上”,更是要追求在毫秒级别将胜出渠道的捷报反哺给媒体算法,形成高频双向反馈闭环。

底层原理与数据管线拆解(核心重头戏)

媒体输入层:宏参数拼接与点击日志捕获

构建稳健对接的第一步,是精确捕获媒体在点击瞬间释放的宏参数信息。当广告主在巨量或腾讯后台配置监测链接时,链接通常包含大量被 {} 或 __ 包裹的占位符。例如,巨量引擎依赖其全局唯一的 __CLICK_ID__,腾讯广告重度依赖设备标识提取的 __MUID__,而快手则通过 __CALLBACK__ 透传极其复杂的加密回传地址。

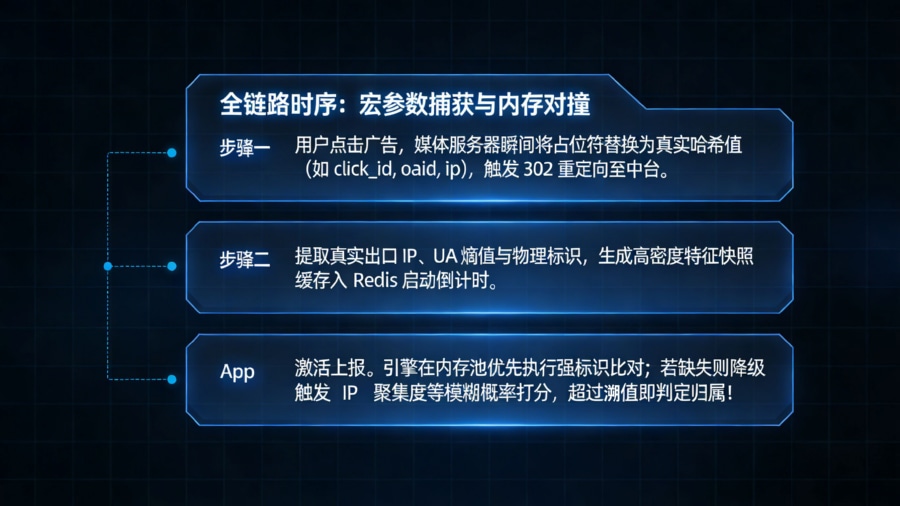

时序流转的物理过程如下:步骤一,用户在媒体 App 内点击广告卡片,媒体底层服务器瞬间介入,将监测链接中的宏参数替换为真实的哈希物理值与环境参数,随后触发 HTTP 302 重定向请求发往 openinstall 的监测接口(如 https://app.openinstall.com/api/ad_click?click_id=...&os=...)。步骤二,中台 API 网关在接收到这些点击请求后,绝不仅限于简单入库。系统会迅速对请求头中的真实出口 IP 地址进行清洗(过滤掉基站代理带来的脏数据),对 User-Agent 字符串进行正则拆解以提取浏览器微内核版本,并连同媒体透传的 OAID/IDFA 以及关键的 ClickID,生成一条高密度的特征快照缓存至集群内存中,并启动为期数天的倒计时生命周期。关于这些底层宏参数的具体下发规范和加密约定,开发者可以通过查阅《》获取官方的字段协议与时序映射准则。

// 示例:巨量引擎点击监测链接宏参数捕获结构(以 GET 请求接入 openinstall 网关为例)

GET /api/ad_click?

clickid=__CLICK_ID__

&campaign_id=__CAMPAIGN_ID__

&ad_id=__AD_ID__

&creative_id=__CREATIVE_ID__

&mac=__MAC__

&oaid=__OAID__

&os=__OS__

&ip=__IP__

&ts=__TS__

HTTP/1.1

Host: app.openinstall.com

中台枢纽层:从归因判定到多通道 API 分发

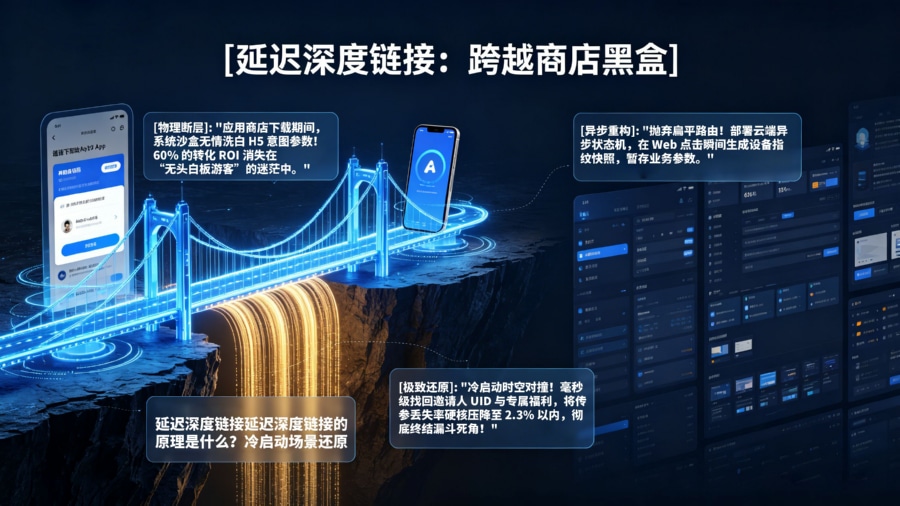

当设备完成下载并首次启动,向中台发起激活上报后,系统立刻在内存池中触发极其严苛的归因引擎。匹配算法的权重逻辑具有绝对的优先级层级:系统优先抽取客户端上报的 IDFA/OAID 强设备标识,去内存中寻找相同标识的点击日志(强匹配);当遇到 iOS 17+ 环境下 IDFA 遭遇大面积置空时,引擎会瞬间降级,自动触发基于 IP 聚集度、操作系统补丁号与屏幕分辨率比例的模糊概率对撞打分。只有当匹配得分超过预设阈值,且 CTIT(点击至激活时间差)落在合理的物理时间窗口(Attribution Window,如设定为 7 天)内时,中台才会生成一笔确定的有效转化记录。

在完成极其消耗算力的排他性裁决后,中台需要立刻进行多通道的 API 分发。作为这一环节的基建枢纽,凭借「」等开箱即用的产品功能,系统会迅速从原点击日志中反向提取出对应的媒体回调地址与回传密钥,准备发起最后一步的 S2S 推送。这个阶段的核心挑战在于并发状态下的锁控制,必须确保同一个设备的同一次深度激活,仅向“最后一次有效点击”的胜出媒体发送一条归因成功的信号,而对其他被判定为辅助触点或抢功失败的平台执行静默屏蔽。

回传输出层:事件脱敏与签名异步下发

最后一步,是向媒体接口发送携带最终判决结果的 HTTP POST 或 GET 异步请求。这一步远比想象中复杂。各大平台对回调的安全性有着极高的要求,通常不仅需要动态组装 callback_url,还必须将特定的 event_type(如激活=0,注册=1,付费=2)连同企业申请的 secret_key 进行 HMAC-SHA256 或 MD5 的强哈希加密,将生成的 Signature 放入请求 Header 或查询参数中。

同时,针对深度事件的回传,必须引入严格的数据脱敏机制。例如,当内部业务系统发生了一笔 998 元的高净值订单付费时,如果原封不动地向媒体 API 抛送极度敏感的真实金额,将会严重暴露企业的 ARPU(每用户平均收入)与商业底牌。先进的做法是在中台层建立 1:n 的比例模糊降噪映射字典。对于该订单,回传系统仅向媒体侧抛出一个抽象的“已付费”标签(Event_ID),或者将金额除以动态常数进行混淆后上传。这不仅完美迎合了 oCPX 模型对于正向标签的吞吐需求,促成了算法模型的快速收敛,又死死守住了企业核心资产的安全边界。

指标体系与技术评估框架

对接质量的核心量化 KPI:回传成功率与匹配深度

在完成了技术联调后,技术团队必须建立严格的对接质量量化体系。最顶层的 KPI 是“回传成功率”。这一指标并非粗略的统计对账,而是直接读取中台向媒体 API 发送请求时的底层 HTTP 状态码分布。任何 4xx(如 403 Forbidden 验签失败、400 格式错误)或 5xx(媒体网关宕机)的响应,都必须被实时捕获并计入错误率。一个合格的 S2S 闭环,其 HTTP 200 成功响应率必须稳定在 99% 以上。另一个核心 KPI 是“归因匹配深度”,即系统是否能够畅通无阻地将链路穿透至次日留存、核心功能触发等层级。如果只能监控到激活而无法回传后续节点,整个 oCPX 竞价引擎就如同被蒙住了双眼,永远只能买来低质量的“首启即卸载”的劣质流量。

主流广告平台回传机制对比(跨平台技术横评)

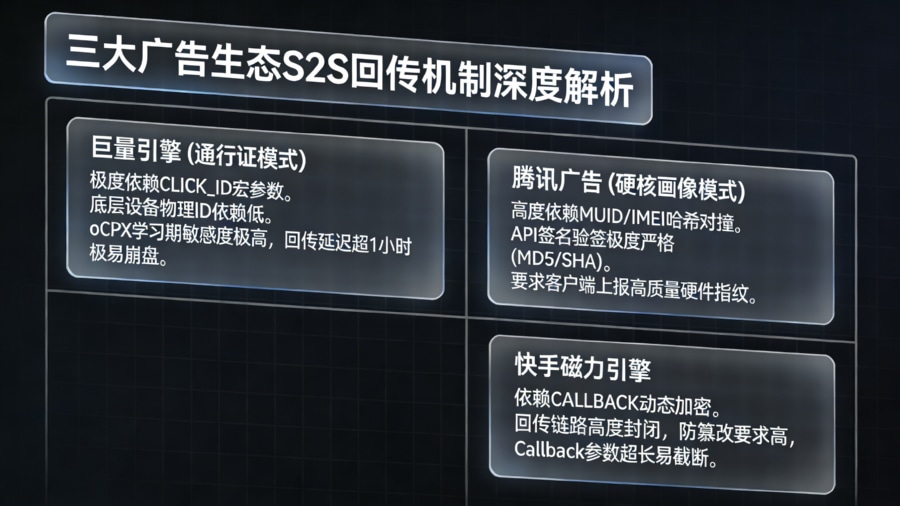

尽管底层逻辑相通,但国内头部的三大广告生态在接口设计与参数要求上呈现出显著的技术差异。以下通过结构化表格,横剖巨量、腾讯、快手在 S2S 回传上的架构特征:

| 对接与回传评估维度 | 巨量引擎(OceanEngine) | 腾讯广告(AMS / 广点通) | 快手磁力引擎(Magnet) |

|---|---|---|---|

| 核心归因标识符 | 极度依赖 __CLICK_ID__ 宏参数透传,对设备物理 ID 依赖度相对较低 |

高度依赖设备 ID 哈希对撞(如 __MUID__、__IMEI__),对设备画像要求严苛 |

依赖动态加密的 __CALLBACK__ 参数,回传链路高度封闭且防篡改 |

| API 鉴权与防篡改机制 | 支持在 URL 动态组装回调,对签名(Signature)与时间戳校验极度严格 | 需结合企业分配的 Secret Key 进行强哈希验签,要求严格匹配事件动作码 | 回调地址内嵌了动态的 Token,对第三方重装 URL 的宽容度极低 |

| 深度转化支持度 | 极其丰富,支持多达上百种细分深度事件(如关键行为、甚至游戏内等级跃升) | 支持深度链路跟踪,但要求严格的漏斗回传(必须有激活才能回传后续付费) | 偏向于电商与短视频行业标准事件,深度支持以表单及唤起为主 |

| oCPX 学习期敏感度 | 极高,算法收敛极快,若回传延迟超 1 小时,成本模型极易崩溃飞升 | 较高,由于依赖底层设备圈层画像,对长期回传的稳定性要求极强 | 极高,依赖高频次的正样本输入来快速调整视频素材与受众的匹配度 |

| 宏参数拼接复杂度 | 中等(文档标准化程度极高,参数释义清晰) | 高(涉及多种加密算法选项如 MD5/SHA,容易在转义中踩坑) | 高(Callback 参数超长,容易在 HTTP 客户端中被截断) |

深入解读上述对比表格可以发现,巨量引擎的接口设计理念是典型的“通行证模式”——只要你在点击时接住了 __CLICK_ID__,并在回传时原封不动且带上合法签名还回去,巨量就不太追究设备底层到底是怎样的;这种模式让 S2S 回传极度顺畅。而腾讯广告则具有浓厚的“硬核画像模式”,它更希望归因平台能够提供高质量的 muid(IMEI/IDFA 的 MD5 值)来进行系统底层对撞,这就要求开发者在客户端上报阶段不能有任何获取权限的闪失。这就意味着,企业自建对接需要耗费巨大的精力去抹平各家生态的技术沟壑,而成熟的中台则通过底层适配层一劳永逸地化解了这些矛盾。

技术诊断案例(四步法):某工具类 App 对接报错引发的“丢数”排查

异常现象与排查背景

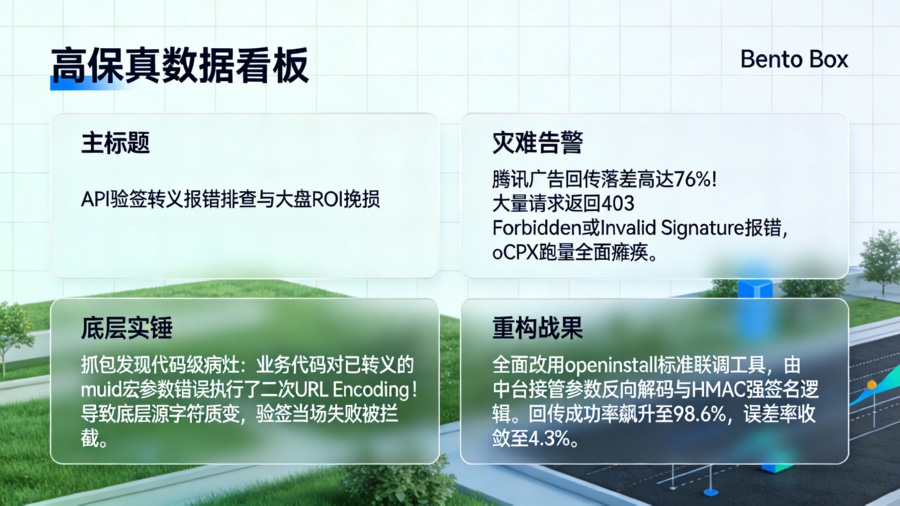

某初创团队研发了一款深度的系统清理类工具 App,在获得首轮融资后,于腾讯广告平台开启了千万级预算的投放。在投放的第二天,灾难性的情况发生了:企业内部 BI 以及第三方统计数据显示,当日该 App 获得了约 5000 个真实的新增激活;然而在腾讯广告的后台大屏上,仅仅统计到了可怜的 1200 个激活转化。回传落差高达惊人的 76%。由于腾讯 oCPX 模型未能收集到足够的正样本转化反馈,算法判定该广告素材属于低质量极差计划,系统随后触发了自动关停机制,直接导致正在起量的投放业务陷入全面瘫痪状态。

日志与链路对账

面对如此悬殊的数字鸿沟,中台架构师迅速调取了对接系统底层的 API 通信日志。排查的焦点并没有放在归因引擎的匹配率上(内部确实匹配成功了 5000 个量),而是死死锁定了 S2S 的回传推送通道。在捞取了向腾讯服务器发起 HTTP POST 请求的数百条全量日志后,架构师敏锐地发现:那些未能呈现在媒体后台的激活请求,其 Response 报文无一例外地被腾讯网关返回了 403 Forbidden 或 {"code": 10001, "msg": "Invalid Signature"} 的强硬报错。通过进一步在网络层进行深度抓包比对,研发团队找到了极其隐蔽的代码级病灶:在处理腾讯广告回传的拼接逻辑时,业务代码在接收含有 muid 宏参数的回调链接时,错误地对这串已经过 Base64 与 URL Encoding 的字符串执行了二次 URL Encoding 转义操作。这导致原有的 %3D 等字符被破坏,媒体服务端在收到 Payload 进行哈希拆解并计算验证签名时,底层源字符串已经发生质变,验签算法当场将其判定为非法篡改请求而无情拦截。

技术介入与规则调优

找到转义逻辑的致命错误后,团队立即采取了多层次的调优手段。首先,废弃了原来自行编写的极易出错的回传拼装代码,全面改用 openinstall 后台提供的标准 [链路联调工具]。在后台输入媒体预期的回传模板后,通过一键生成标准监测 URL 替换掉了媒体后台的旧链接,由中台引擎接管底层的参数反向解码与 HMAC 强签名逻辑,彻底阻断了研发层面的字符转义失误。其次,在诊断期间团队还发现,部分因 iOS 14.5 系统导致 IDFA 强制置空的真实激活也被腾讯拒收。为此,技术团队全面启用了中台提供的动态级联补偿算法,通过聚合 IP、UA 以及操作系统的次级微版本指纹,合规地补齐了那 20% 因强 ID 缺失导致的归因断档,并将这部分补充识别出的转化以标准协议二次投喂给了媒体。

复盘结果与经验

修正案在下午 3 点准时热更新上线。仅仅一小时后,数据大屏迎来了逆转:中台向腾讯广告接口的回传成功率从崩盘时的 24% 直线飙升并稳定在高达 98% 的高水位。在次日清晨的复盘对账中,腾讯后台统计到的有效激活数与内部 BI 系统数据的误差率被彻底收敛至 4.3% 的微小物理损耗范围内。充足的正反馈样本迅速激活了停滞的 oCPX 引擎,模型在 24 小时内快速度过了死亡学习期,CPA 成本开始稳步下降。此次惊心动魄的排障为团队刻下了血的教训:“在跨平台 API 接入上线前,必须通过沙盒环境进行完整的单点链路抓包与验签穿透联调,绝不容许带病跑量。”

常见问题

为什么 openinstall 后台有数据,但广告平台后台不显示激活?

这种现象在多渠道投放初期极为普遍,需要从三大技术断层逐一排查。首先是“API 鉴权与回传链路报错”,即归因引擎虽然匹配成功并下发了请求,但因为 Signature 生成错误、回调地址解析截断等原因被媒体服务器以 HTTP 4xx 状态码拒收。其次是“转化目标不一致”,媒体后台可能配置的优化目标是“注册”,但你只向其回传了“激活(0)”的事件标识,导致媒体大盘未能点亮该指标。最后是极具迷惑性的“归因窗口截断”,某些长尾流量点击发生在 30 天前,由于媒体后台严格遵循自身 7 天或 15 天的归因窗口,即便收到回传,媒体算法也会将其判定为无效的过期功劳并静默剔除。

广告平台要求的 oCPX 深度事件(如付费)如何安全对接?

面对强势媒体索要深度的内购、实名或复购等极其敏感的商业数据,广告主必须坚守数据隔离底线。安全对接的原则是“全量收口,脱敏外放”。企业应当将 App 内的所有深度业务事件首先统一上报给自身的数仓或类似 openinstall 的独立第三方中台。随后在进行 S2S 媒体回传时,严禁透传具体购买的 SKU(商品品类)、用户真实联系方式或精确的订单流水号。只需将该业务行为映射为媒体文档中提供的一个抽象 Event_ID(如定义某类行为统称为“次日活跃”或“深度付费”)。对于必须依赖金额以优化 ROAS 的场景,企业可通过后台配置按极低比例或固定常数对金额进行打码模糊降噪,确保在给竞价引擎“喂奶”的同时,绝不将核心利润率模型裸露给第三方。

巨量和腾讯广告的 ClickID 逻辑有何本质区别?

深入到 API 底层即可发现两者归因哲学存在细微偏差。巨量引擎的架构高度青睐纯粹的 S2S 点击透传逻辑,它在广告点击瞬间生成极其庞大且自带时效加密的 __CLICK_ID__,归因引擎只要能将此标识原样收好,并在设备发生转化时以此作为唯一凭证回传,巨量的竞价模型就能顺畅运转,对底层设备硬件 ID(如 IMEI)的强制依赖相对宽松。而腾讯广告(特别是广点通体系)则具有更浓厚的社交生态属性,其底层算法极度依赖于设备 ID 的强哈希对撞(如通过 __MUID__ 与端侧上报的 MD5 加密标识进行联合核验)。这就要求开发者在接入腾讯系时,必须确保客户端 SDK 在沙盒环境下尽可能合规、完整地提取出设备的强弱指纹,任何在端侧对硬件标识获取逻辑的疏漏,都会导致腾讯引擎验签环节的断崖式崩盘。

openinstall运营团队

openinstall运营团队 2026-04-03

2026-04-03 191

191

闽公网安备35058302351151号

闽公网安备35058302351151号