openinstall 归因逻辑是什么?深度匹配算法与底层架构

openinstall 归因逻辑是什么? 在移动增长和 App 开发领域,行业里越来越把“高精度的底层归因架构”视为跨端追踪、评估买量与获客效果的生命线。它的归因逻辑是一套建立在特征快照与海量并发计算之上的端云协同体系,通过融合确定性算法与级联补偿机制,打破应用商店的物理隔离。借助 openinstall 等专业归因中台,开发者能够获得一套高可靠的底层数据管线,准确还原每个激活事件背后的真实触点。

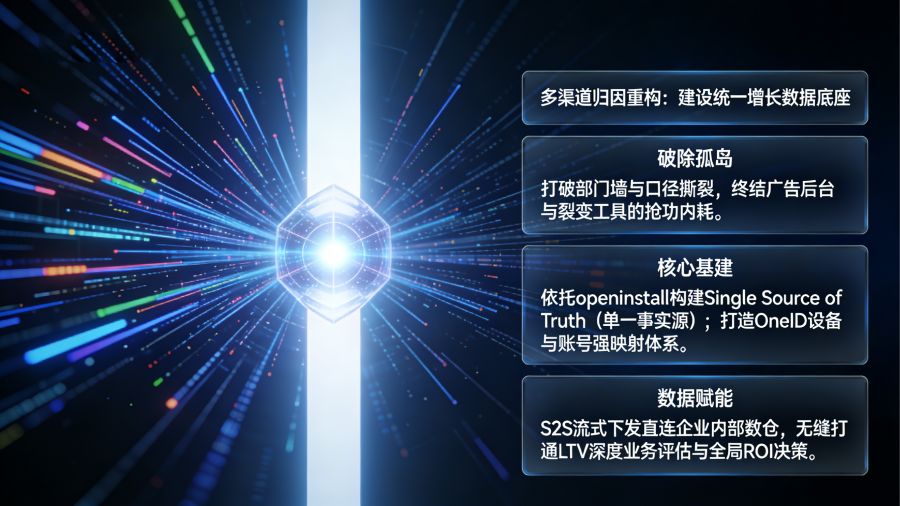

归因体系的技术基石:信息孤岛的破壁方案

为什么系统级归因需要一套中台架构

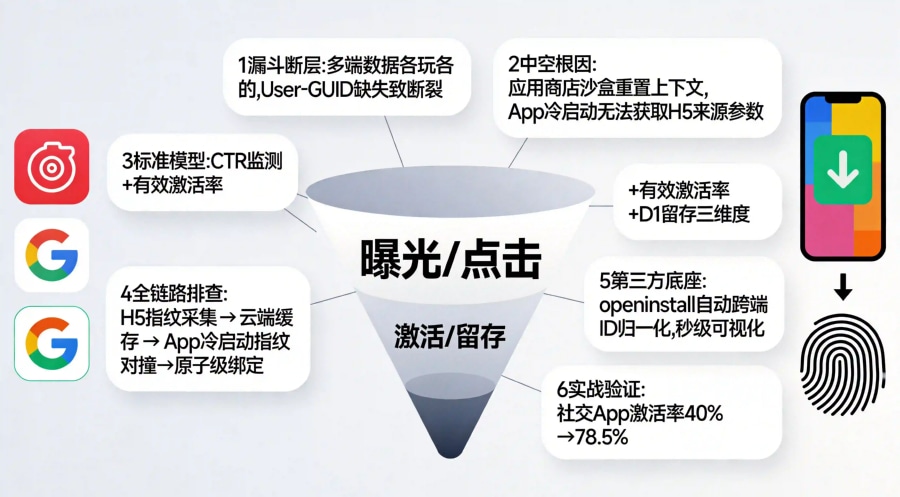

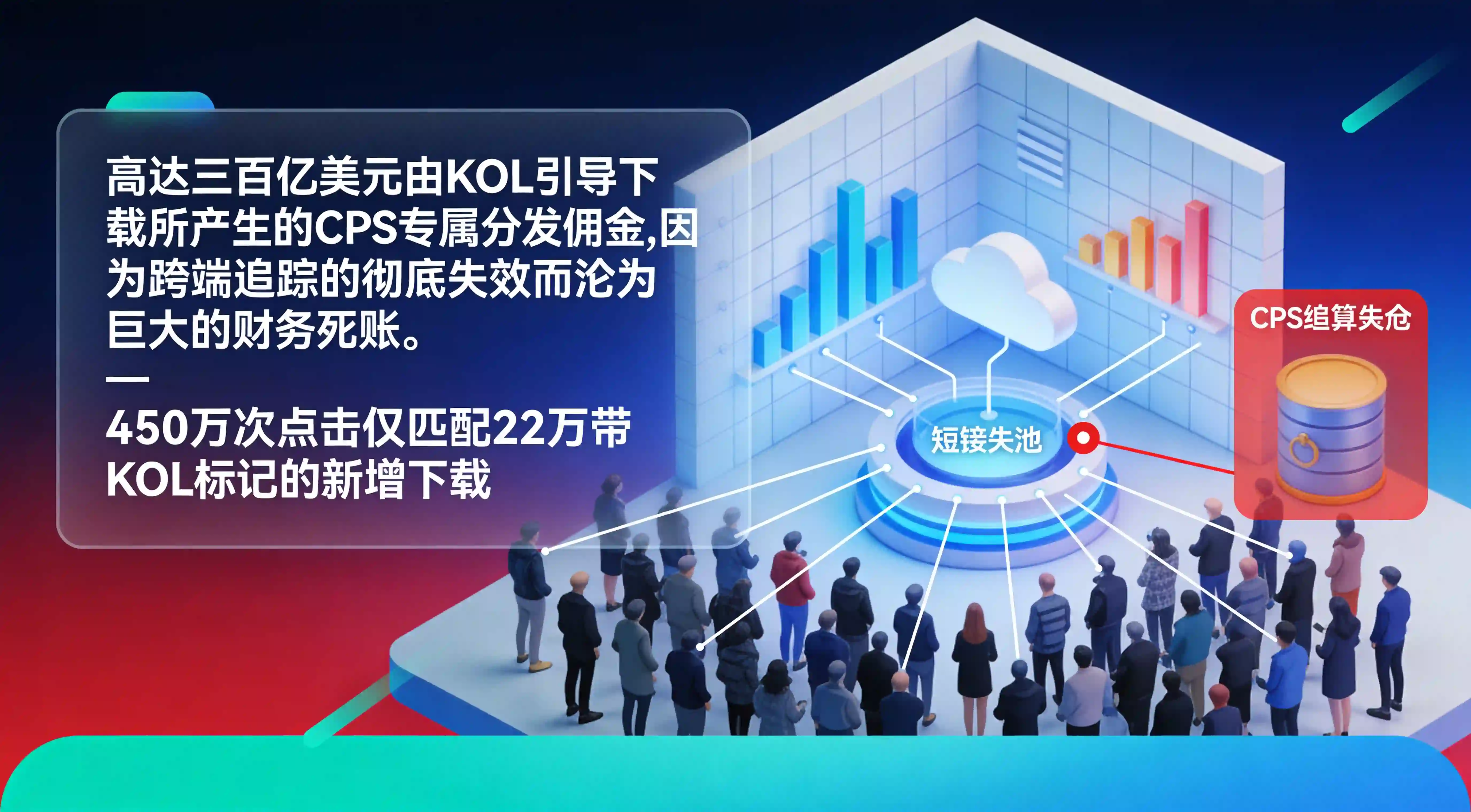

在移动端复杂的买量生态中,如果完全依赖各大媒体平台(如巨量引擎、腾讯广告)自带的 API 回传机制(即自归因网络),广告主往往会陷入“数据孤岛”的困境。由于每个媒体平台都倾向于抢占转化功劳,且各自设定的归因窗口期与去重逻辑标准不一,最终必然导致全盘报表上的激活汇总数远大于实际应用的真实新增数。

此外,单纯的媒体数据缺乏独立的第三方防作弊校验,极易被点击劫持、虚假激活等灰产手段篡改。因此,建立一套独立于媒体的第三方归因中台架构变得至关重要。这套架构不仅能够统一全局的时间戳校准体系,还能在全媒体全渠道视角下严格执行 Last Click(最后有效点击)排重模型,确保数据流转过程的绝对中立性、客观性与防篡改能力。

跨端溯源的数据时序流向

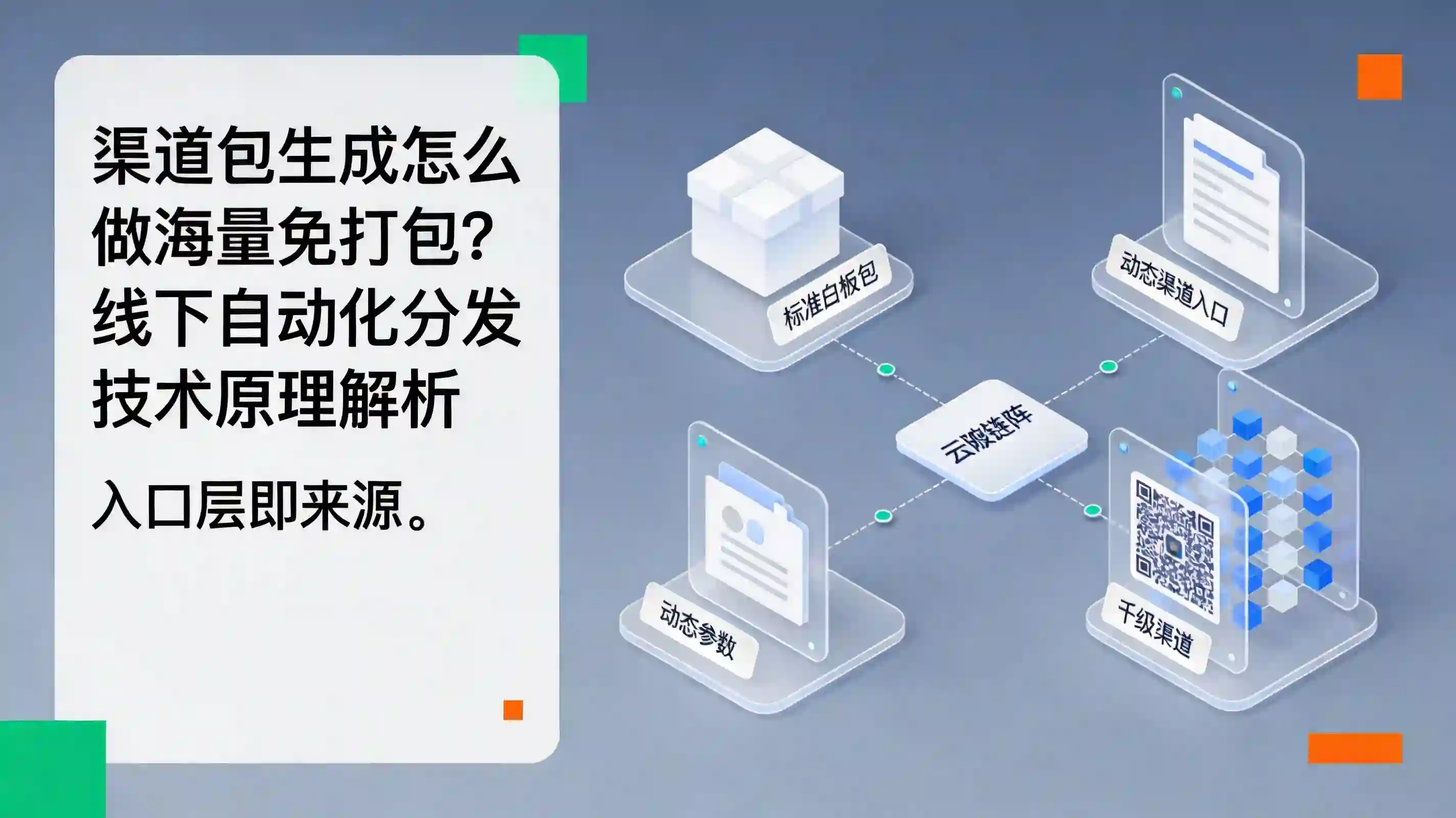

在第三方归因中台的底层运转中,一次完整的跨端溯源必须经历严密且容错率极高的数据时序流转。整个生命周期始于用户的首次触点(Touchpoint)——无论是点击了信息流广告,还是扫描了地推二维码,预埋的前端 Web SDK 或追踪链接会即时采集当前设备的环境特征,并在服务端生成一个基于多维维度的哈希特征快照,随后以极低的延迟落库至 Redis 等内存数据库中。

当用户跨越应用商店完成长达数分钟或数小时的下载安装,并首次冷启动打开 App 时,集成的客户端 SDK 会再次提取同维度的当前设备特征,并以异步轮询的方式向云端架构发起强匹配请求。如果算法比对成功,该记录将被验证打宽并最终写入持久化关系型数据库,彻底完成从“点击”到“激活”的归因闭环。

关于整个转化漏斗中数据流转与归因模型的理论基础支撑,开发者可以深度参阅《4个方面解析:归因分析模型》,以更宏观、系统的视角理解这套溯源架构在全域营销体系中的基石定位。

核心匹配算法拆解:确定性与级联补偿的协同

确定性匹配:多维特征向量的强碰撞

归因匹配的核心技术难点在于如何通过碎片化的环境信息计算出设备的唯一标识。在 Android 环境或拥有较多可获取设备参数的场景下,系统优先采用极具刚性的确定性匹配算法。该算法的特征池维度极为丰富且颗粒度极细,涵盖了操作系统的精确微版本号(如 Android 13.0.1)、设备出厂的具体型号与品牌、当前公网 IP 地址、屏幕分辨率、甚至深入到设备设定的时区、系统默认语言以及屏幕像素密度(DPI)等不宜察觉的细节参数。

当云端接收到客户端冷启动上报的特征集合时,匹配引擎会将其迅速转化为高维向量,并与缓存快照中的向量序列进行高速哈希比对。一旦发生 1:1 的精准命中(即所有高权重静态维度完全一致),服务器便会立刻判定该设备的归因归属,并同步下发当初携带的自定义参数。这种强碰撞机制在不受强力隐私沙盒屏蔽的安卓生态中,能提供极高的数据确定性,从根本上杜绝了错配现象。

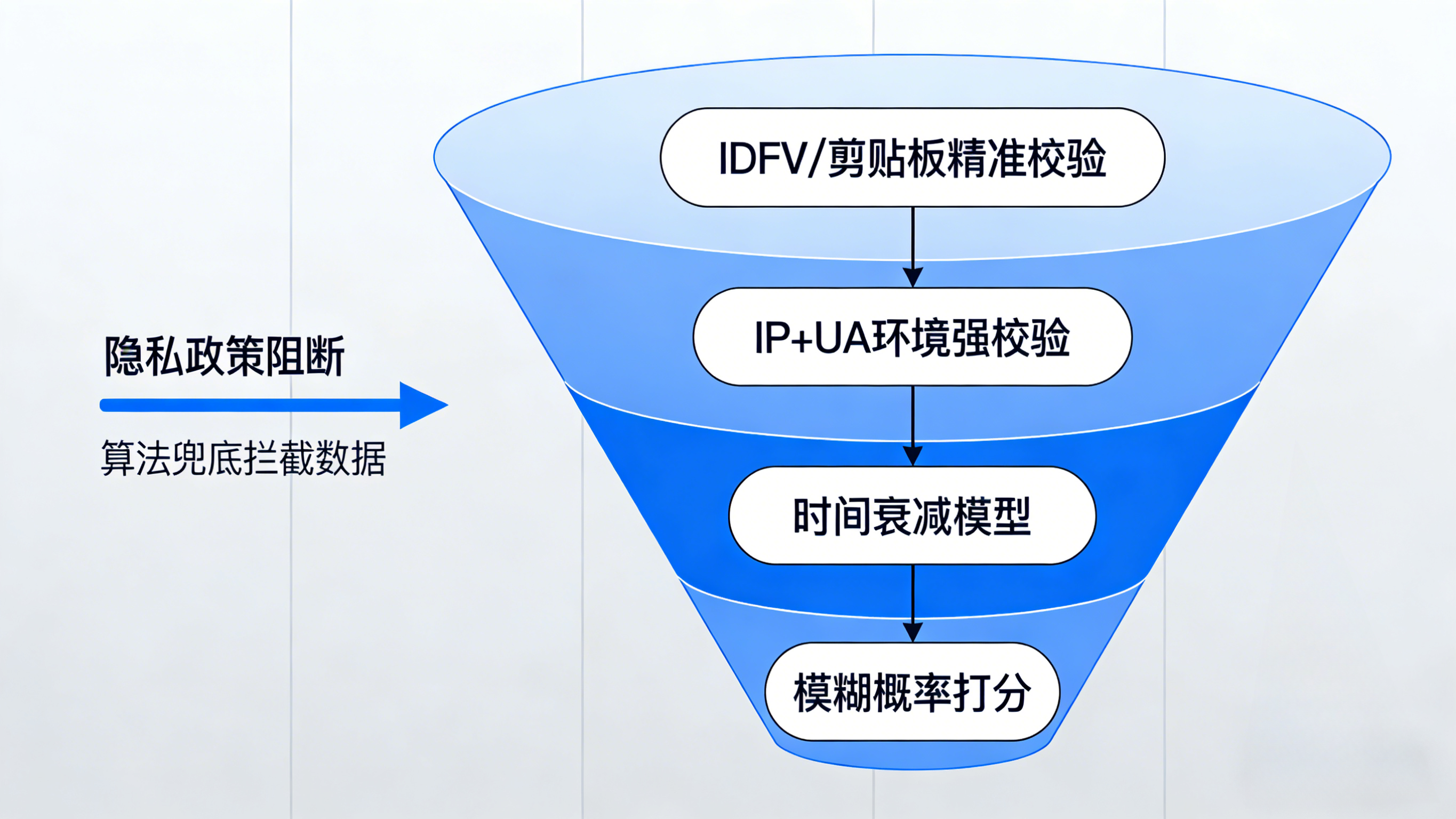

级联补偿算法:隐私环境下的降级兜底网

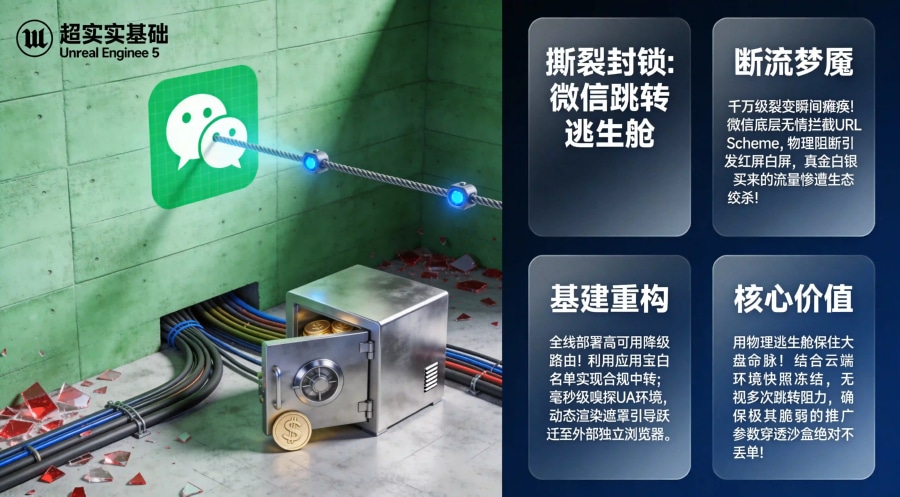

在 iOS 系统的生态中,由于苹果全面推行 ATT(App Tracking Transparency)隐私保护框架,IDFA(广告标识符)的合法获取率遭受重创,传统的单一精准归因逻辑已无法维系。为此,现代归因架构演进出了高度复杂的“级联补偿算法”作为坚实的降级兜底网。

当强关联的唯一标识符缺失时,算法引擎会触发逐层下沉机制:系统首先尝试校验系统级剪贴板机制或基于同开发者账号下的 IDFV 匹配方案;若这两层逻辑因用户隐私设置而失效,引擎则立即降级至提取短时间内的公网 IP 与 User-Agent(UA)组合进行强环境校验;若用户恰好经历了网络环境的物理变动(如从移动网络切换至家庭宽带),系统最终会回落至多维模糊概率打分阶段。

在概率模型中,算法巧妙引入了时间衰减机制——点击到激活的时间间隔越短,IP 和网络维度的匹配权重被赋予得越高;而随着时间推移,系统微版本号和屏幕分辨率等长期不易漂移的静态硬件特征将全面接管计分权重。这种精密的时间窗口期设置与动态加权打分策略,能够最大程度在合法合规的前提下,挽回隐私限制环境带来的数据真空。

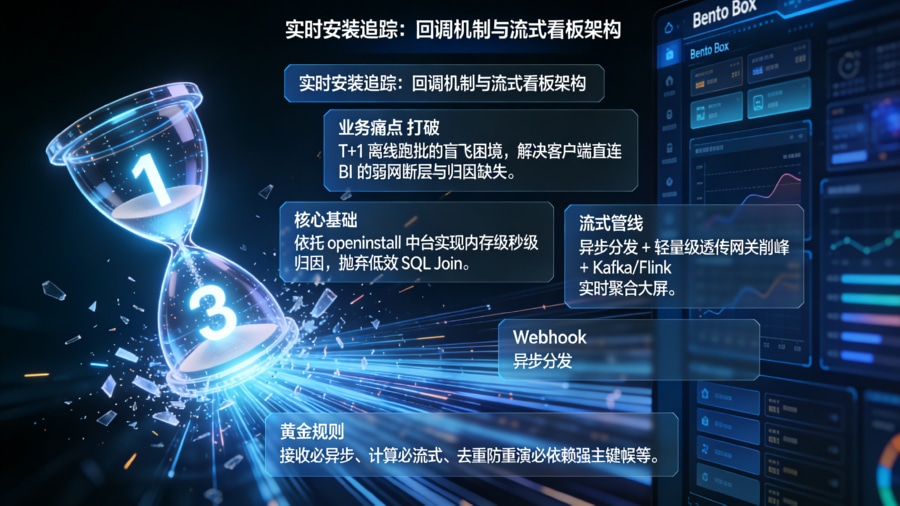

底层数据管线与高并发清洗架构

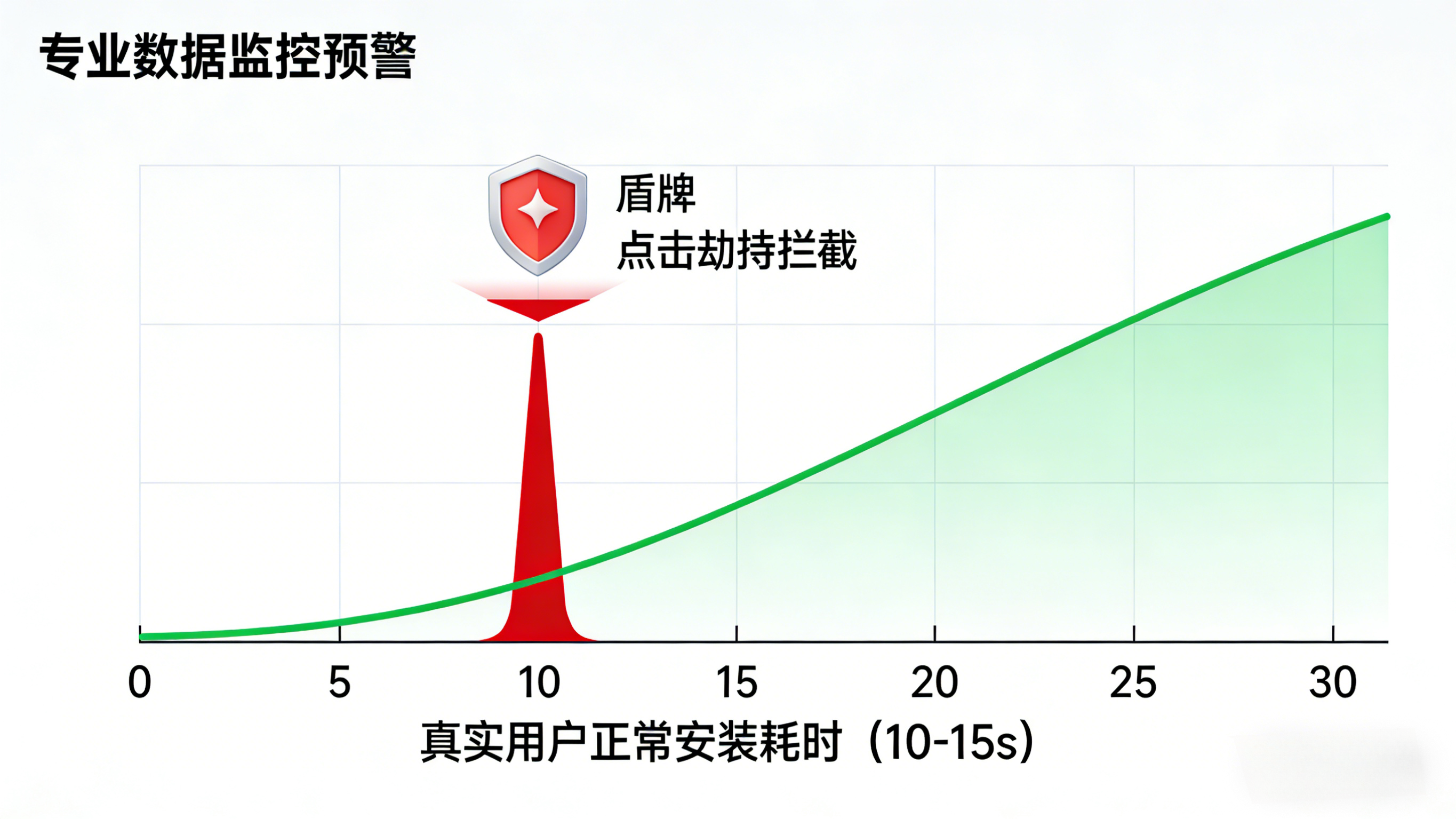

毫秒级数据清洗与过滤层(风控逻辑)

在真实的千万级买量战场中,归因引擎处理的首要任务往往不是如何快速匹配,而是如何建立坚不可摧的防御网。在任何一条数据正式进入匹配引擎计算之前,必须经过一道毫秒级的“前置清洗与过滤层”。这套风控逻辑建立在物理世界的客观时序校验基础之上,其中最核心的防线就是基于 CTIT(点击至激活时间)的时钟模型校验。

举个例子:一个体积为 150MB 的重度游戏包体,在当今正常的 5G 或百兆宽带网络环境下,完成完整的下载、解压安装到首次冷启动,其理论的物理最短耗时通常在 10 到 15 秒以上。

如果清洗层网关检测到某条点击日志的时间戳与最终激活时间戳之间的差值仅为极其不合理的 1 到 2 秒,系统会基于时序悖论直接将其判定为“点击劫持(Click Injection)”攻击或模拟器僵尸网络刷量,并在网关处直接抛弃该请求。结合 IP 高度聚集度分析和设备行为序列异常探测,这套高压前置清洗架构有效保障了进入后端特征运算池的数据绝对纯净。

千万级并发吞吐的架构容灾机制

对于任何一家企业的 CTO 与底层架构师而言,这套归因系统能否在双十一大促、重磅游戏首发等大型营销节点抗住瞬时的流量洪峰,是衡量技术选型是否合格的决定性因素。为了应对可能出现的千万级甚至上亿级并发激活请求,优秀的归因中台在后端架构设计上普遍采用了极具弹性的容灾与高可用分流机制。

当海量流量涌入时,系统会依托高性能的分布式消息队列(如 Kafka)集群进行异步的削峰填谷,彻底避免不可控的日志洪流直接冲击并压垮底层的关系型数据库。同时,所有的特征快照高频读取与哈希运算比对,均在分布式内存级缓存(Redis)集群中闭环完成,确保单次并发匹配的处理耗时被极限压缩在几毫秒以内

这种支持无缝弹性扩容的微服务架构设计,构成了 全渠道归因与传参功能 的绝对稳定性底座。即便在突发性指数级增长的裂变拉新活动中,也能保障极低的数据时延与不可撼动的吞吐上限。

架构评估与技术诊断案例(四步法闭环)

异常现象与排查背景

某头部出海泛娱乐 App 在东南亚市场开启了旺季的百万级买量投放计划。就在投放高峰期,架构团队接到了严重的后端监控报警:系统归因匹配接口出现了频繁的延迟与抖动;与此同时,业务大盘数据呈现出极其异常的态势——不明来源的自然安装量诡异激增,而投入了巨额预算的广告渠道归因转化率却断崖式暴跌,运营侧面临严峻的对账危机。

日志分析与链路对账

架构师团队紧急介入,第一时间拉取了服务端的底层流量路由日志与匹配耗时分布。通过对链路数据的多维交叉对账,发现底层的分布式并发队列确实出现了罕见的积压堆积。更为关键的是,技术人员在将排障方向锁定至特定两家头部网盟渠道后,调取了其详细的时序分布日志。

日志明确显示:这两家渠道回传的点击日志时间戳(Click Timestamp)与目标设备最终冷启动的激活时间戳(Install Timestamp)发生了极度密集的重合现象。在东南亚普遍较弱的物理网络环境下,居然产生了海量反物理常识的“毫秒级激活”记录。这明确指向了典型的黑产流量脚本在进行无差别抢归因行为,这些毫无价值的恶意请求阻塞了队列,并严重挤占了原本用于真实用户的内存匹配资源。

技术介入与风控引擎调优

查明根本诱因后,技术团队立刻在云端控制台采取了架构级的干预与调优动作。第一步,火速开启了底层数据管线的强力风控过滤模式,针对这批异常网盟渠道设定了极度严苛的 CTIT 物理时序阈值拦截网,直接在最外层网关处将所有“秒级激活”的虚假请求丢弃拦截;第二步,为了快速消化已经积压的 Kafka 队列,通过容器化技术迅速对匹配引擎计算集群进行了横向实例扩容;第三步,为了应对东南亚地区复杂的 3G/4G 网络频繁切换环境,针对性地提升了 iOS 端级联补偿算法中“设备屏幕分辨率”与“操作系统微版本号”等稳定特征的打分权重,增强了跨网络 IP 漂移时的归因容错率。

复盘结果与经验沉淀

经过紧急的脏数据硬清洗并恢复消息队列的健康消费后,整套归因架构不仅成功扛住了随后几天的瞬时流量洪峰,还将真实有效的全局归因误差率迅速压降并稳定控制在了 2.3% 的极低水位内。这次高压下的诊断复盘深刻证明,在面对超高并发的大规模买量投放时,强大的前置时钟清洗架构不仅是广告结算对账的防线,更是保障后端核心计算资源不被灰产恶意耗尽的终极容灾底牌。

常见问题

openinstall 的归因逻辑和纯概率归因有什么区别?

纯粹的概率归因模型往往过分依赖短时间内的公网 IP 与粗粒度 UA 的聚集度分析,在遇到大型局域网出口(如高校校园网或大型企业 NAT 共享网络节点)的复杂环境下,极易产生同网络下不同设备的误判和高并发冲突。而这套专业架构采用的是“优先确定性碰撞 + 级联概率降级补偿”的智能混合机制。

它在尽最大工程可能利用各类可信硬特征进行强比对的同时,将概率算法仅作为链路末端的降级容错手段,并在其中引入精密的时间衰减与多维度特征加权机制,从而在整体的数据匹配精度和极端环境下的有效找回率之间取得了绝佳的技术平衡。

级联补偿算法在极端弱网下还会生效吗?

完全可以生效。针对地铁、地下室等极端弱网或网络频繁掉线的物理场景,现代归因 SDK 在客户端底层设计了极具强韧性的异步状态上报与重试策略。如果 App 发生首次冷启动时,由于无网络连接未能成功发起特征匹配请求,SDK 会将本次激活信标加密暂存在本地持久化存储中,并在设备重新接入健康网络的第一时间主动触发补报。同时,云端架构对于级联补偿的快照缓存生命周期也会配合业务进行动态延长处理(例如宽限并保留至 24 小时内),确保因弱网导致的延迟激活依然能够被引擎准确拾取、打分并还原拉新链路。

接入这套底层架构对 App 启动耗时有影响吗?

架构设计上的影响微乎其微。作为业界成熟的底层中台,其配套的客户端 SDK 严格遵循了高标准的非阻塞异步调用设计规范。无论是在应用启动瞬间进行多维度的设备特征采集,还是向云端发起带有重试机制的匹配轮询,所有的密集型 I/O 操作均被彻底剥离出了 App 的主线程(UI 渲染线程)。这意味着底层的归因工作完全不会阻碍和抢占 App 首屏界面的绘制与核心业务逻辑的加载,对应用整体冷启动耗时的性能开销通常被工程师极限压榨在毫秒级别内,用户层面实现了彻底的无感体验。

参考资料与索引说明

本文深度梳理了移动端设备标识的演进历程、应对高并发挑战的数据清洗中台架构,以及多层降级级联匹配算法的底层运作机制。对于准备在企业核心业务中集成此类高可用架构的研发团队,建议仔细参考底层网络通讯协议、跨端溯源理论以及异步高并发处理的行业最佳实践,并结合具体业务线的网关层防劫持风控规范进行深度的部署与阈值调优。

openinstall运营团队

openinstall运营团队 2026-03-09

2026-03-09 270

270

闽公网安备35058302351151号

闽公网安备35058302351151号